Фабрика политических автоматов

Только создание армии роботов, которая полностью устранит человеческий фактор и позволит человеку уничтожить что-то простым нажатием кнопки, может изменить эту фундаментальную зависимость власти от насилия.

Ханна Арендт 494

Когда Адорно работал над своими «Minima moralia» в 1944 году, самолеты-снаряды «Фау-1» и «Фау-2», при помощи которых нацисты бомбили Лондон, становятся одним из предметов его рассуждений 495. В длинном фрагменте, озаглавленном «вне досягаемости», он писал: «Если бы философия истории Гегеля охватила и нашу эпоху, то эти бомбы-роботы, “Фау-2” Гитлера, заняли бы в ней свое место… наряду с эмпирическими фактами, о которых известно, что они непосредственно и символическим образом выражают государство, которое постиг Мировой дух. Как и сам фашизм, эти роботы запущены на полной скорости и в то же время без всякого субъекта.

Как и он, они сочетают техническое совершенство с полной слепотой. Как и он, они порождают смертельный ужас, и совершенно напрасно. “Я видел Мировой дух не на коне, а с крыльями ракеты и без головы” – именно в этом состоит опровержение философии истории Гегеля» 496.

Опровержением Гегеля, потому что история стала безголовой, а сам мир утратил свой дух. Механика одолела телеологию. Субъект исчез. В самолете больше нет пилота, а оружие больше не является сущностью человека.

Но буквально через несколько строчек Адорно добавляет к первому утверждению важнейший диалектический нюанс. Подчеркнув, что в этом вооруженном насилии без боя противнику отныне отводится роль «пациента или трупа», к которому смерть применяется в форме «административных и технических мер», он добавляет: «Вместе с чем-то поистине дьявольским в самом факте того, что, в определенном смысле, отныне требуется больше инициативы, чем в классической войне, и требуется, так сказать, вся энергия субъекта для того, чтобы никакого субъекта больше не было»497.

Оружие само по себе становится единственным явным актором насилия, средством которого оно является: этот кошмар уже вырисовывается на горизонте. Но перед тем, как в очередной раз провозгласить смерть субъекта, необходимо немного остановиться на этом рассуждении о вдохновлявших Адорно самолетах-призраках, которые запускал угасающий Третий рейх: требуется вся энергии субъекта, чтобы никакого субъекта больше не было.

Политическая ошибка заключается в нашей вере в то, что автоматизация сама по себе является чем-то автоматическим. Организовать свертывание политической субъективности становится основной задачей самой этой субъективности.

В этом мире доминирования, которое осуществляется путем конверсии его приказов в программы и превращения его агентов в автоматы, власть, какой бы удаленной она ни была, становится неуловимой.

Где находится субъект этой власти? Этот вопрос сегодня становится навязчивым, если мы берем за основу неолиберализм или постмодернизм. Фраза Адорно дает нам хорошую подсказку, где можно ее найти: она, возможно, везде или же активно работает над тем, чтобы ее забыли. Именно эта напряженная активность в процессе самоустранения обозначает ее точнее всего. Вся эта субъективная суета, которая требует огромных усилий и инвестиций, для того чтобы запутать следы, стереть отпечатки, ловко скрыть всякий видимый субъект действия, чтобы превратить его в чистую функциональность, в некое подобие явления природы, обладающее своего рода неотвратимостью и лишь слега подправляемое системными администраторами, которые время от времени исправляют баги, осуществляют обновление и регулируют доступ.

Министерство обороны США предполагает «постепенно уменьшать долю управления, зависящую от человеческих решений» в том, что касается управления дронами 498. Если в первое время планируется перейти к «управляемой автономии», то в долгосрочной перспективе строятся виды на автономию полную. Таким образом, человеческие акторы не будут задействованы ни внутри, ни около, они окажутся полностью вне цикла. Это перспектива «роботов, способных использовать летальную силу без контроля или вмешательства человека» 499.

Специалист по робототехнике Рональд Аткин сегодня является одним из самых активных сторонников этой «роботизированной летальной автономии» 500. Его главный аргумент также «этического» порядка: роботы-солдаты «будут потенциально способны действовать более этическим образом на поле боя по сравнению с солдатами-людьми»501. И даже лучше: они смогут «вести себя более гуманным образом, чем человеческие существа в сложных обстоятельствах»502.

«Лично я надеюсь, признается он, чтобы как-то оправдать свои исследования, что мы никогда не будем в них нуждаться, ни сегодня, ни завтра. Но порыв, который заставляет людей вести войну, кажется слишком ошеломляющим и неизбежным». Увы, если войны нельзя избежать, то хотя бы попробуем сделать ее более этичной, вооружившись нашими технологиями. Действительно, если нам это удастся, то «мы совершим выдающийся гуманитарный прорыв» 503. Ну еще бы…

Но почему роботы-солдаты могут «действовать на поле боя более этическим образом по сравнению с солдатами-людьми?» 504 По целому ряду причин, в основном за счет своей «точности», но главным образом потому, что их можно запрограммировать для соблюдения законов.

Эти роботы будут оснащены тем, что он называет «нравственным управлением», то есть чем-то вроде «искусственной “совести”» или машинным сверх-Я 505. Летальное действие будет предлагаться другой программой, но эта программа принятия решений пропустит ее через фильтр законов войны, переведенных на язык деонтической логики, чтобы «удостовериться в том, что оно является этически допустимым действием» 506.

У этих роботов не будет ни эмоций, ни страстей, которые могут помешать им принять решение, они будут применять эти правила буквально как хладнокровные убийцы. Именно потому, что они не будут «демонстрировать ни страха, ни гнева, ни чувства мести» 507, ведь они лишены этих важнейших человеческих качеств, которые называются аффектами, эти машины, предположительно, будут человечнее человека, то есть более этичными. Для реализации этой аутентичной человечности необходимо избавиться от человеческих существ.

Ликвидировать их.

Но эти парадоксальные рассуждения кажутся абсурдными лишь на первый взгляд. Чтобы их понять, мы должны проследить, как они обыгрывают разные значения понятия «человечность», слова, которым принято обозначать как минимум две вещи: с одной стороны, человеческие существа, их сущность, с другой – норму поведения, сам факт «человечного» поведения. Смысл онтологический и смысл аксиологический. Сама возможность гуманизма заключается в этом семантическом разрыве, который, как ни странно, призывает людей быть людьми, то есть приспособить реальность определенных форм нравственного поведения к его идеалу. Но поскольку конститутивным действием философского гуманизма является установление жесткой зависимости между этими двумя смыслами, робоэтический постгуманизм принимает в расчет их несогласованность, оперируя их реальным расхождением. Если люди иногда могут действовать бесчеловечно, то почему нелюди не могут стать человечнее их, то есть лучше соответствовать нормативным принципам, определяющим, что значит поступать «человечно»? Аксиологическая человечность может стать свойством нечеловеческих акторов, ведь этих «искусственных моральных акторов» всего лишь нужно запрограммировать для следования хорошим правилам. Пока что все (практически) безупречно. Все становится куда серьезнее, когда рассматриваемое действие является человекоубийством. Сторонники летальной робоэтики по сути говорят: не важно, что теперь машины решают, убивать им людей или нет. Поскольку они убивают их человечно, то есть в соответствии с принципом международного гуманитарного права, которое регулирует применение военной силы, никаких проблем нет. Но в чем именно проблема? С точки зрения философии права можно обозначить две крайне важные и на самом деле нерешаемые проблемы.

Во-первых, наделить механических агентов правом на убийство, которым взаимно наделены во время войны комбатанты, приравнивает убийство к разрушению бездушной вещи, что приводит к радикальному отрицанию человеческого достоинства. Право, принимающее в расчет подобные случаи, может привести к появлению третьего смысла человечности, который наложит запрет на использование подобного оружия, признав человеческий род объектом защиты высшего порядка.

Во-вторых, действующее ныне право военных конфликтов, фокусируясь на использовании оружия 508, устанавливает возможность реального различия между оружием, которое рассматривается как вещь, и комбатантом, который рассматривается как использующее его лицо, несущее за него ответственность. Но летальный робот подрывает основы этой имплицитной онтологии права. Это непредвиденный случай вещи, которая использует сама себя. Оружие и комбатант, инструмент и актор, вещь и личность любопытным образом сливаются в единую сущность, не имеющую статуса.

Эта проблема проявляется прежде всего в кризисе юридических категорий: могут ли некоторые вещи рассматриваться в качестве личностей? Но она также приводит, в чисто практическом смысле, к радикальному кризису применимости права.

Все вертится вокруг вопроса ответственности, а через него – вокруг самой возможности дистрибутивной справедливости, связанной с правом войны.

Робот совершает военное преступление. Кто за это ответит? Генерал, который его отправил? Государство, которое им владеет? Компьютерщики, которые его запрограммировали? Промышленник, который его построил? Обитатели этого тесного мирка, скорее всего, будут переводить стрелки друг на друга. Военачальник всегда может сказать, что он не отдавал приказа роботу и в любом случае его больше не контролировал. Государство – собственник машины, в его юридическом статусе «хранителя имущества», несомненно, будет нести часть ответственности, но оно сможет, сославшись на то, что ущерб связан с дефектом производства, переложить ее на промышленника, который в свою очередь попытается свалить все на программистов в случае обвинения в причинении ущерба третьему лицу. Останется только сам робот: в этом случае придется сажать в тюрьму машину, приписать ему человеческие мотивы поведения и после процесса казнить в общественном месте, подобно преступной свинье, приговоренной к смерти за убийство ребенка в 1386 году в деревне Кальвадос 509. В чем, конечно же, будет не больше смысла, чем бить и оскорблять мебель, о которую мы ударились, чтобы отбить у нее желание повторить нечто подобное.

Если коротко, то мы получим целый набор ответственных и безответственных лиц, которым будет крайне сложно приписать авторство убийства. Больше никто не будет нажимать на кнопку, нужно будет отыскать в хитросплетениях – как юридических кодексов, так и программных кодов – ускользающий субъект.

Парадокс в том, что вместе с подобной автономизацией летальных решений единственным человеческим актором, который может быть непосредственно идентифицирован в качестве действующей причины смерти, будет сама человеческая жертва, имевшая несчастье неуместными движениями своего тела, как это уже происходит с противопехотными минами, запустить автоматизированный механизм своего уничтожения.

Исчезнет не просто установление персональной ответственности, а она сама: будучи распределенной по обезглавленной сети множественных акторов, она постепенно утратит свою квалификацию, из намеренного став ненамеренным, из военного преступления – военно-промышленным инцидентом. Почти как в случае «мусорных облигаций», которые умышленно производятся в финансовой сфере, становится крайне сложно понять, кто кому и что должен. Этот типичный диспозитив фабрики по производству безответственности.

Но зачем так переживать из-за поиска действительно виновных, хором спрашивают специалисты по робоэтике, если преступление таким образом будет невозможным? Каким бы странным ни казалось подобное возражение, необходимо оценить весь масштаб проекта, с которым оно связано. Здесь важен именно способ имплементации юридической нормы. Чтобы соблюдать ограничения скорости, предусмотренные правилами дорожного движения, можно либо установить штрафы и поставить повсюду радары, либо поставить ограничители скорости в каждую машину. Это два совершенно различных способа совместить норму с определенной инстанцией: текст-санкция или интегрированный технический контроль.

Или определить право и накладывать санкции апостериори, или же «инкорпорировать этические и правовые нормы непосредственно при разработке оружия»510. Но дальше этого аналогия не идет, так как в случае с роботом-убийцей, без какого бы то ни было водителя на борту, больше не будет никого, кто будет прямо за него ответственен, то есть того, кого можно было бы обвинить в случае происшествия.

Это прекрасно известно сторонникам «warbots», или боевых роботов. Но они уже сделали свой выбор между международным уголовным судом и этичными роботами-убийцами.

Потому что (внимание!), добавляют они, только высочайшая «преданность идее индивидуальной уголовной ответственности в качестве предохранительного механизма может остановить разработку устройств, которые могли бы, в случае успеха, существенно снизить потери гражданского населения»511.

Если сам закон обещает стать машиной, человеческое правосудие может исчезнуть.

Но к этому стоит добавить следующее: их утверждение о том, что возможно интегрировать закон в «сам принцип разработки оружия», – это чудовищное злоупотребление языком. Все, что могут сделать специалисты по робоэтике, это внедрить некоторые правила при разработке определенных программ, которые, разумеется, всегда могут быть деинсталлированы или изменены. Если вы легко можете проделать это со своим компьютером, то уж поверьте, на это способна любая армия в мире. Дискурсивная операция на самом деле заключается в том, чтобы оправдать разработку крайне опасного hardware с перспективой благодетельного software, которое идет с ним в комплекте. Поздравляем: купив машину (или, точнее, робот-танк), вы выиграли замечательный брелок.

Это типичный механизм «Троянского коня»: ради создания в будущем этичных роботов-убийц согласиться на разработку роботов-убийц как таковых. Притом что их сторонникам прекрасно известно, что общественное «мнение» до сих пор отвергает их за явным большинством. Представляя процесс автоматизации чем-то автоматическим, неизбежным и щедро предлагая избежать возможных крайностей, Аркин и те, кто ему поддакивают, скрывают тот факт, что они являются активнейшими действующими лицами этого процесса512, и всячески его ускоряют, подыскивая ему оправдания, в которых он пока еще нуждается для достижения успеха. Чем шире распространяется миф об этичном роботе, тем меньше становится нравственных ограничений для использования роботов-убийц. Забывая при этом, что самый надежный способ предотвратить преступления, которые киборги совершат завтра, это убить их в зародыше сегодня, пока для этого еще есть время513.

Лос-Анджелес, 2029 год. Над руинами города в иссиня-черной ночи флуоресцентные вспышки озаряют небо. На землю падает ниц человеческий комбатант, сраженный лазером робота-самолета. Гусеницы призрачного танка переезжают груду человеческих черепов. Это знаменитая сцена из «войны машин, направленной на истребление человечества», которой открывается «Терминатор» Джеймса Кэмерона, один из первых фильмов, в котором мельком появляется дрон, в 1984 году еще как атрибут научной фантастики.

Все утопии и дистопии структурируются при помощи одной и той же фундаментальной и упрощенной схемы: через парный термин человек/машина. Механизм либо представляется в виде сервильного приложения к человеческому суверену, либо, напротив, машина, добившись автономии, больше не подчиняется контролю своих старых хозяев и восстает против них, как в сценарии «Терминатора».

В подобных историях, изначально представляющих дистанционного оператора или пилота как всемогущего актора, предсказано его грядущее поражение. Человек вскоре утратит свое господствующее положение. Дроны станут роботами. Этот переход к полному автоматизму, добавляется при этом, вписан в сценарий диспозитива, необходимого для его развития: «в отдаленной перспективе любой шаг в сторону дистанционного управления означает шаг в сторону роботов», предсказывал Марвин Минский в 1980 году514. За изначальным субъектоцентризмом следует предсказуемая смерть субъекта, который, как принято считать, потеряет все что имел, а самое главное – контроль. В этом парадоксальность данной модели: будучи радикально антропоцентричной в своем начале, она оказывается затронута постепенным преобразованием, которое заканчивается гарантированным исключением человеческого субъекта.

Но обе эти точки зрения одинаково неверны.

Вальтер Беньямин, анализируя в свое время положение пилота бомбардировщика, предлагал более реалистичный подход к первой ситуации:

«Один пилот самолета с газовыми бомбами обладает на войне такой же властью лишать людей света, воздуха и жизни, которая в мирное время поделена между тысячами чиновников.

Там, где скромный командир бомбардировщика действует в своем высоком, небесном уединении по поручению тяжелобольного шефа – государства» 515. Чтобы понять, каким типом актора является пилот, необходимо мыслить его в отношении, которое он поддерживает с другим типом машины: не с самолетом, а с государственным аппаратом, концентрированным выражением силы которого он в этот момент является, хотя и подчиняясь принципу субординации. Притом что он располагает ограниченной свободой маневра, пилот лишь на первый взгляд является одинокой и всемогущей личностью, которая предстает в образе «человека – повелителя машины». На самом же деле он является не чем иным, как фетишизированным воплощением бюрократической машины современного государства, его временным сгустком в одной точке, одной руке или большом пальце. Именно этот процесс позволяет технически завершить дронизация боевого самолета, устранив еще одно крайне несовершенное звено, связывающее государственный аппарат с его боевыми машинами.

В своей книге «Wired for war» Питер Сингер описывает следующую сцену: четырехзвездный американский генерал проводит часы в своем кабинете, просматривая изображения, передаваемые дроном Predator, перед тем как снять трубку и отдать личный приказ открыть огонь, уточняя при этом, какой именно тип бомб должен использовать пилот для нанесения удара. Это пример полной потери координации уровней командования, когда стратег вмешивается в самый нижний уровень принятия тактических решений 516. Сингер предостерегает от подобного смешения ролей из соображений военной эффективности. Его урок в любом случае ясен: пока теоретики «сетевых войн» полагали, что новые технологии позволят произвести определенную децентрализацию управления «на практике, опыт применения беспилотных устройств свидетельствует об обратном» 517.

Не столько «человек» как таковой утрачивает контроль в пользу «машины», сколько операторы в более низких чинах (все более) утрачивают свою автономию в пользу представителей высших эшелонов военной иерархии. Полная роботизация скорее усилит эту тенденцию централизации принятия решений, хотя и не столь явным образом, куда более экономичным, но от этого не менее гипертрофированным.

Как объясняет специалист по робототехнике Ноэль Шарки (который как раз является убежденным противником подобных программ), программное обеспечение, отвечающее за принятие решений «этичным роботом», должно в обязательном порядке, помимо содержащихся в нем правил, подобно всякой программе, получать спецификации518. Перевести императив «целиться только в легитимные мишени» в строчки программного кода будет совершенно бессмысленной операцией, если в спецификации не указано, чем является этот изменяющийся «target». Схожим образом можно попытаться запрограммировать формализованное выражение принципа пропорциональности (успехов)519, но необходимо будет специфицировать для программы значение, прямое или косвенное, порога приемлемых пропорций потерь гражданского населения и достигнутых военных успехов. Одним словом, параметры решения должны быть специфицированы, и эта спецификация не выполняется самой программой. Что потребует также решения о параметрах решения, то есть решения о решении.

Централизация командования, даже если она будет выражаться в спецификациях для определенных программ, а не в приказах, приобретет несоразмерные пропорции, потому что изменение значения единственной переменной величины позволяет, за счет одного решения о решении, фиксирующего параметры всех автоматически принимаемых решений в данном сегменте, раз и навсегда определить ход неисчислимого множества будущих действий. Зафиксировать значение спецификации определенной программы будет означать подписание бесконечно воспроизводимого смертного приговора, причем куда более эффективным и централизованным образом, чем в случае совокупности отдельных приказов.

Современные армии уже используют программное обеспечение, которое должно помочь им лучше соответствовать требованиям права войны и тем самым сделать их более «этичными». Из чего можно предположить, каким образом на практике могут быть закреплены соответствующие ценности: «С самых первых дней вторжения в Ирак они запустили программы. Они называли это программой “раздавленной козявки” (“bug-splat”).

Эта программа оценивала, какое количество гражданских лиц будет убито при данном авианалете. Результаты, представленные генералу Томми Фрэнксу, указывали, что двадцать две запланированные бомбардировки повлекут за собой высокое число тех, кого они называли раздавленными козявками – или около тридцати убитых гражданских в ходе каждой атаки. Фрэнкс сказал: “Вперед, парни, мы сделаем это все двадцать два раза”»520.

Жестокость военных в данном случае не является, как утверждал Аркин, следствием ошибок и злоупотреблений низших чинов, рядовых солдат, которых вводит в заблуждение туман войны или охватывает пыл боя. Эта жестокость изначально не является чем-то драматическим. Она состоит всего лишь в том, чтобы установить приемлемое значение переменной величины. Каково будет значение, соответствующее переменной величине «Minimum Carnage»? Неизвестно. Больше тридцати убитых гражданских. О’кей. Но это незначительное решение о решении, которое заключается в одном слове или нажатии на клавишу, имеет самые разнообразные последствия, при этом очень конкретные, и даже чересчур конкретные.

Как ни странно, это все еще может кого-то удивить: самое страшное преступление состоит не в открытом нарушении закона, а в отступлениях от его суверенного применения. Обыденная военная жестокость пребывает в своем праве, спокойно в нем устроившись за непробиваемым словесным щитом. Без крайней необходимости она никогда из-за него не показывается. Формы современной военной жестокости в массе своей являются легальными. Они функционируют скорее в качестве правила, а не в качестве исключения. Если они все же являются исключением, то не из-за приостановки действия закона, но скорее из-за его спецификации или уточнения в соответствии с их интересами, до тех пор, пока он не сдается практически без боя. Эта жестокость формалистична, хладнокровна, технологически рациональна и подчинена расчетам, той разновидности расчетов, которая должна сделать весьма этичными роботов-убийц будущего.

Когда июльское восстание 1830 года достигло своего апогея и становилось понятно, что населению Парижа удастся сбросить режим, герцог Ангулемский обратился к своему помощнику со следующими словами:

«– Уничтожьте баррикады.

– Сударь, на них восставшие, а они сопротивляются.

– Прикажите национальной гвардии стрелять в повстанцев.

– Сударь, национальная гвардия отказывается стрелять.

– Она отказывается! Это бунт, прикажите войскам стрелять по национальной гвардии.

– Но войска отказываются стрелять по национальной гвардии.

– Тогда стреляйте по войскам521».

Но, разумеется, уже не оставалось никого, кто мог бы это сделать…

В 2003 году, когда фирма Northrop Grumman представила военным прототип своего боевого дрона Х-47А, один из офицеров в сердцах воскликнул: «По крайней мере, этот самолет не будет мной командовать»522.

Вопреки тому, что предполагали научно-фантастические сценарии, опасность не в том, что роботы перестанут подчиняться; все как раз наоборот: они никогда не выйдут из подчинения.

Потому что в ряду человеческих слабостей, которые роботы призваны устранить, есть одна, о которой забыл упомянуть Аркин: способность быть непокорным523. Роботы, конечно, сбоят и выходят из строя, но они не артачатся. Роботизация солдата, которая ошибочно считается фактором повышения его этичности (но при этом верно, что новое определение «этики» через способность механически подчиняться правилам означает, что она станет синонимом дисциплины и самой тупой покорности), на самом деле является наиболее радикальным решением старой проблемы отсутствия дисциплины в армии. Покончить с самой возможностью неподчинения. Сделать непокорность невозможной. Даже рискуя таким образом упразднить, одновременно с возможностью злоупотреблений, основной фактор внесудебного ограничения вооруженного насилия – критическое сознание акторов524.

Проблема не в том, человек или «машина» обладает контролем. Это необоснованная формулировка. Реальный смысл заключается в материальной и политической автономизации этой «группы вооруженных людей», которая и является государственным аппаратом.

* * *

Теории порой замечательно описываются при помощи единственной иллюстрации. На фронтисписе «Левиафана» изображен гигант, торс которого возвышается над страной.

Мы узнаем все классические атрибуты суверена: меч, корону, скипетр. Но внимание привлекает скорее его облачение. Кольчуга, в которую он облачен, да и само его тело, сотканы из крохотных человеческих тел. Государство – это артефакт, машина, даже «машина машин», но составляющие ее детали – не что иное, как живые тела его подданных.

Загадка суверенитета, его содержания, но также и его возможного распада кроется в материале, из которого он построен: из чего сделано государство?

Фронтиспис «Левиафана». 1651. Фрагмент

То, что сделал Гоббс, Ла Боэси хотел разрушить, причем тем же самым способом, потому что повелитель, который вас угнетает и «за которого вы бесстрашно идете на войну, за величие которого вы не отказываетесь идти на смерть… Откуда взял бы он столько глаз, чтобы следить за вами, если бы вы сами не давали их ему? Где бы он достал столько рук, чтобы бить вас, если бы он не брал их у вас же?» 525 В этом состояло базовое материальное противоречие: если тело государства состоит исключительно из наших тел, мы всегда можем от него избавиться.

Именно по этой причине, объясняет Арендт, из-за этой фундаментальной телесной зависимости, власть государства – даже в самых авторитарных режимах – должна, несмотря ни на что, быть властью, а не чистым насилием526. Без тела нет власти. Но, как она полагала, в определенном смысле верно и обратное: без мобилизации тел власти больше нет.

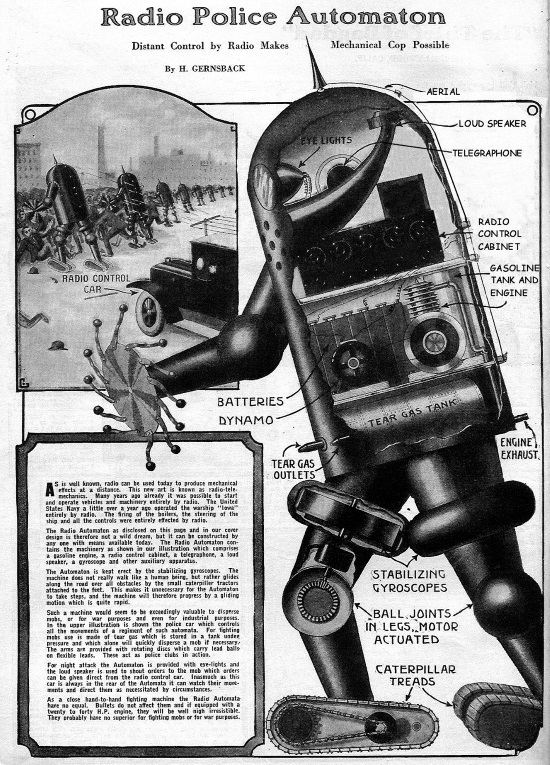

Иное время, иные образы. В 1924 году научно-популярный журнал сообщал о новом изобретении – радиоуправляемом полицейском автомате. Робокоп ревущих двадцатых должен был быть оснащен глазами-проекторами, ногами на танковых гусеницах, а в качестве кулаков – вращающимися полицейскими дубинками по образцу средневекового оружия.

Небольшой металлический пенис внизу живота позволял ему распылять слезоточивый газ на беспорядочно бегущих манифестантов. Вместо ануса – паровыпускная кнопка. Этот потешный робот, писающий слезоточивым газом и пукающий столбами черного дыма, избивая при этом толпу, замечательно иллюстрирует наше государство-дрон.

Разница между двумя этими образами выражает смысл политики дронизации и роботизации железных рук государства.

Его мечта – получить силу без тела, политическое тело без человеческих органов – где старые тела призванных на службу подданных были бы заменены механическими орудиями, которые в идеале стали бы его единственными акторами.

Государственный аппарат, таким образом, действительно превращается в аппарат, получая наконец тело, соответствующее его сущности: холодное тело самого холодного из чудовищ.

Оно наконец реализует техническими средствами свое главное устремление – стать государством, ведь, как писал Энгельс, «и эта сила, происшедшая из общества, но ставящая себя над ним, все более и более отчуждающая себя от него, есть государство» 527. Но когда оно доберется до этого этапа, то, возможно, ему суждено оказаться на свалке подобно куску старого металлолома.

* * *

493 Lysiak, “Marschflugkorper VI vor Start”, Bundesarchiv Bild 146-1973-029A-24A

494 Hannah Arendt, Du mensonge a la violence, Calmann-Levy, Paris,

1989, p. 151. О выражении «политические автоматы» см.: “Et vous trouvez да drone?”, p. 141, Z, n 2, Marseille, automne 2009, p. 141.

495 Эти беспилотные аппараты не имели радиоуправления, они были механически запрограммированы на падение на поверхность после того, как преодолеют определенное расстояние. Фау – «V» в их названии являлось сокращением от Vergeltungswaffen – «оружие возмездия».

496 Theodor Adorno, Minima moralia, Payot, Paris, 2008, p. 72–73.

497 Ibid. P. 73.

498 The Unmanned Systems Integrated Roadmap FY 2011–2036, p. 14.

499 Gary E. Marchant, Braden Allenby, Ronald Arkin, Edward T. Barrett, Jason Borenstein, Lyn M. Gaudet, Orde Kittrie, Patrick Lin, George R. Lucas, Richard O’Meara, Jared Silberman, “International Governance of Autonomous Military Robots”, Columbia Science and Technology Law Review, vol. 12, 2011, p. 272–315, 273. Корейский робот SGR-1 является сегодня одним из предшественников этих машин будущего. Расположенные на границе между двумя Кореями, в демилитаризованной зоне, эти стационарные роботы могут обнаружить присутствие человека за счет своих датчиков (камер, но также детекторов движения и тепловизоров), прицелиться в определенное лицо и, в случае авторизации оператора, открыть огонь из пушки или автоматического гранатомета.

500 “Lethal autonomous robotics” (LAR). «Автономный» в данном случае значит, что платформа способна принимать решение сама, без участия человека.

501 Ronald Arkin, “The Case for Ethical Autonomy in Unmanned Systems”, 2010, hdl.handle. net/1853/36516

502 Ronald Arkin, “Ethical Robots in Warfare”, Technology and Society Magazine 28, no. 1 (Spring 2009): 30.

503 Ronald Arkin, “Governing Lethal Behavior: Embedding Ethics in a Hybrid Deliberative/Reactive Robot Architecture” (2007), 98, hdl.handle.net/1853/22715

504 Arkin, “Ethical Robots in Warfare”.

505 Ronald Arkin, “An Ethical Basis for Autonomous System Deployment, Proposal 50397-CI, Final Report”, 2009.

506 Ronald Arkin, Patrick Ulam, and Brittany Duncan, An Ethical Governor for Constraining Lethal Action in an Autonomous System, Technical Report GIT-GVU-09-02, 2009.

507 Arkin, “Ethical Robots in Warfare”.

508 См.: Vivek Kanwar, “Post-Human Humanitarian Law: The Law of War in the Age of Robotic Warfare”, Harvard Journal of National Security 2 (2011).

509 См.: Michel Pastoureau, Une histoire symbolique du Moyen Age occidental, Paris, Seuil, 2004, p. 33.

510 Kenneth Anderson and Matthew Waxman, “Law and Ethics for Robot Soldiers”, Policy Review, no. 176 (December 2012).

511 Ibid.

512 Рональд Аткин годами трудился над их разработкой благодаря щедрой финансовой поддержке военно-промышленного комплекса, включая DARPA, армию США, Savannah River Technology Center, Honda R&D, Samsung, CS Draper Laboratory, SAIC, NAVAIR, а также Бюро военно-морских исследований (Office of Naval Research),

513 В сентябре 2009 года физик Юрген Альтман, философ Питер Асаро, специалист по робототехнике Ноэль Шарки и философ Роберт Спароу организовали Международный комитет по контролю за роботизированным оружием (International Committee for the control of robotic weapons, the Committee for Robot Arms Control, ICRAC), который призывает к запрету роботизированных убийц. Его сайт: icrac.net

514 Marvin Minsky, “Telepresence”, Omni, June 1980, 204.

515 Беньямин В. Маски времени. Цит. соч. С. 374.

516 Эндрю Кокбёрн также сообщает о чем-то подобном (Буш, лично отдавший приказ открыть огонь по конвою машин, следующему в Кандагар), отмечая, что прямая видеотрансляция дает политическим лидерам «невероятное и совершенно иллюзорное ощущение непосредственного контроля». Andrew Cockbum, “Drones, Baby, Drones”, London Review of Books, March 8, 2012, 15.

517 Peter W. Singer, Wired for War: The Robotics Revolution and Conflict in the 21st Century, New York, Penguin, 2009, 34.

518 Noel Sharkey, “Killing Made Easy: From Joystick to Politics”,цитируется no: Robot Ethics: The Ethical and Social Implications of Robotics, ed. Patrick Lin, Keith Abney, and George A. Bekey, (Cambridge, MA: MIT Press, 2012), 123.

519 Хотя закон о вооруженных конфликтах определяет принцип пропорциональности как правильное соотношение между предполагаемыми сопутствующими потерями и масштабом ожидаемых военных успехов, он не предлагает никакой шкалы или единицы измерения. Как отмечает Шарки: «Нет никаких известных способов объективно измерить бесцельное, чрезмерное или диспропорциональное страдание. Для этого требуется суждение, вынесенное человеком. Ни один закон войны не предлагает объективного способа расчета, что значит быть пропорциональным» (Sharkey, “Killing Made Easy”). Подчинять принцип пропорциональности расчетам – все равно что складывать вместе яблоки и груши, не имея способа их распознать.

Каким образом соотносится определенное число потерь среди гражданских лиц с ожидаемым военным успехом? Что за общая единица расчета может быть применена в данном случае? При этом, как показал Эяль Вайцман, подобные расчеты, столь же необходимые, сколь и невозможные, служат исключительно для оправдания смертей, причем выполняют эту функцию явочным порядком. См.: Eyal Weizman, The Least of All Possible Evils: Humanitarian Violence from Arendt to Gaza, London, Verso, 2012, p. 12ff.

520 Allan Nairn, цитируется no: Robert C. Koehler, “‘Bugsplat’: The Civilian Toll of War”, Baltimore Sun, January 1, 2012. См. также: Bradley Graham, ‘“Bugsplat’ Computer Program Aims to Limit Civilian Deaths at Targets”, Washington Post, February 26, 2003.

521 Ferdinand d’Estemo, Des privileges de Tancien regime en France et des privileges du nouveau, vol. II, Paris: Guillaumin, 1868, p. 69.

522 Matthew Brzezinski, “The Unmanned Army”, New York Times Magazine, April 20, 2003.

523 В одном из своих интервью Аркин предвидит подобное возражение: «Они не всегда будут следовать приказам. У робота должна быть возможность отказать в выполнении приказа, если он будет расцениваться как неэтичный», то есть как не соответствующий jus in bello, заложенному в его программное обеспечение. Однако солдаты из приведенного нами примера отказываются стрелять в восставших не потому, что они преданно следуют закону военных конфликтов. Они не хотят ассоциировать себя с властью, отдающей приказы, не из-за формы, а из-за содержания, то есть из-за их политического смысла. Тогда как роботы определенно на это не способны. Sofia Karlsson, “Ethical Маchines in War: An Interview with Ronald Arkin”, owni.eu/2011/04/25/ethical-machines-in-war-an-interview-with-ronald-arkin

524 Это одна из причин озабоченности авторов недавнего доклада: «Устраняя вовлеченность человека в решение о применении летальной силы в ходе военного конфликта, полностью автономное оружие также поставит под вопрос иные, экстралегальные способы защиты населения. Во-первых, роботы не будут наделены человеческими эмоциями и способностью к состраданию… Поэтому лишенные эмоций роботы могут служить орудием диктаторов, которые захотят сломить сопротивление своего народа, не опасаясь, что их собственные войска выступят против них… Эмоции не всегда приводят к беспричинному убийству». Human Rights Watch, Losing Humanity: The Case Against Killer Robots, November 2012, 4.

525 Ла Боэси, Э. Рассуждение о добровольном рабстве / пер. с фр. Ф. А. Коган-Бернштейн. М.: Изд-во Академии наук, 1952. С. 13.

526 Arendt. Op. cit. Р. 151.

527 Маркс К., Энгельс Ф. Сочинения. Цит. соч. Т. 21, С. 170.

«Радиоуправление делает возможным создание механического полицейского». 1924528