Книга: Вероятности и неприятности. Математика повседневной жизни

Назад: Глава 2. Знакомимся со случайностями и вероятностями

Дальше: Возможность невероятного

Что мы имеем в виду, говоря о вероятности?

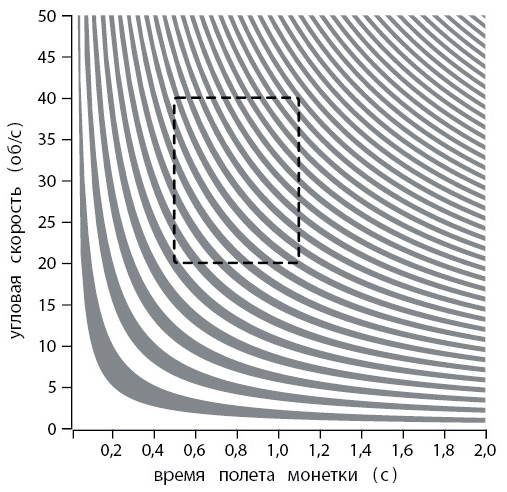

Начнем разбираться с простенькой монеткой и посмотрим, каким может быть источник неопределенности в эксперименте с подбрасыванием. Задача подробно рассматривалась в 1986 году Джозефом Келлером, и здесь мы приведем простое объяснение возникновению неопределенности в этом нехитром процессе, основанное на рассуждениях из его статьи. В самом первом приближении то, какой стороной упадет монета, зависит от времени ее полета t и угловой скорости ω. Если измерять последнюю в оборотах за единицу времени, то число оборотов, совершаемое монетой, выражается предельно просто: n = tω. Эта зависимость задает линии равного числа оборотов в координатах (t, ω), а они, в свою очередь, ограничивают области, соответствующие четному и нечетному числу оборотов: тому, сменится ли сторона монетки после подбрасывания или нет. Пример такой диаграммы показан на рис. 2.1.

Рис. 2.1. Диаграмма, показывающая четность количества оборотов монеты в полете. Прямоугольником показана область, в которой чаще всего происходит процесс гадания на монетке при подбрасывании рукой

С помощью этой полосатой диаграммы можно выяснить, каким будет результат подбрасывания монетки, закрученной на известное число оборотов в секунду и пойманной через известное время после броска. Если попадаем в белую полоску, выпадет та же сторона, что была сверху при броске; если в серую — обратная. Линии равного числа оборотов представляют собой гиперболы; видно, что по мере увеличения числа оборотов чередование областей становится все более частым, а сами области оказываются тоньше. Человеческая рука несовершенна, и очень небольшой разброс начальных значений перекрывает сразу много областей, делая исход непредсказуемым. В диапазоне действия руки (прямоугольник на диаграмме) смещения на 5 % достаточно для того, чтобы перескочить с белой полоски на серую. Остается вопрос: как из этого построения следует «честность» настоящей монеты? Как из такой диаграммы получить вероятность выпадения орла или решки?

Чтобы перевести наши рассуждения на язык вероятностей, окунемся в математику, которую не проходят в школе. И хотя от нее ожидают чего-то сложного, сейчас она упростит дело и поможет лучше понять, о чем мы рассуждаем.

Во введении я говорил, что математики изучают не числа или геометрические фигуры, как может показаться после изучения школьного курса. Они работают со сложными структурами (абстрактными алгебрами, полукольцами, полями, моноидами, топологическими пространствами и прочей абстрактной всячиной), описывают их, вроде бы совершенно не привязываясь к практике, корректно определяют, изучают их свойства, доказывают теоремы. А потом они оттачивают мастерство в поиске подобных структур в самых разных явлениях природы и областях человеческих знаний, совершая удивительно полезные прорывы, в том числе в чисто прикладных областях. Сейчас мы рассмотрим, как строится базис теории вероятностей, основанный на достаточно абстрактном понятии меры.

Мы описали механику монетки и получили области, описывающие множества решений с определенными свойствами. Области — плоские фигуры. Как правильно перейти от них к вероятностям? Нужно измерять наши области, и мы естественным путем приходим к их площади. Площадь — мера плоской фигуры. Это точный математический термин, обозначающий функцию, которая множеству ставит в соответствие некую неотрицательную числовую величину.

В математике есть целый раздел, который называется теорией меры. Она родилась на рубеже XIX–XX веков (у ее истоков стояли французы Эмиль Борель и Анри Леон Лебег) и открыла математикам широкие возможности для анализа очень сложно устроенных объектов: канторовых и фрактальных множеств. Теория меры легла в основу функционального анализа и современной теории вероятностей. Определение вероятности как меры позволяет увидеть все ее основные свойства как для дискретных, так и для непрерывных множеств.

Хотя наша книга не учебник, на этом стоит остановиться, чтобы взглянуть на понятия теории вероятностей как бы с «высоты птичьего полета» и почувствовать вкус «большой» математики. Я прошу читателя не пугаться, если что-то в приводимых ниже определениях покажется непонятным. Если язык математики вам незнаком, воспринимайте это как отрывок текста «в оригинале» на незнакомом вам языке. Он может быть не полностью понятен, но в нем нет искажений «переводчика» и не нарушена целостность. При изучении истории, литературы или иностранных языков необходимо работать или хотя бы знакомиться с оригинальными текстами и полными цитатами. Язык математики тоже требует знакомства с «оригиналом», поскольку в текстах определений и теорем ничего ни прибавить, ни убавить без потерь не получится. Попытки сократить текст «для ясности» порой приводят к серьезным неточностям и вовсе к ошибкам. Итак, вот как звучит определение меры.

Пусть имеется множество X.

Набор его подмножеств F называется алгеброй, если для F верно:

1) пустое множество принадлежит F: ∅ ∈ F;

2) если множество A ∈ F, то и его дополнение X\A ∈ F;

3) если A и B ∈ F, то их объединение A∪B ∈ F.

Из этого определения следует, что пересечение множеств A и B принадлежит F, а также то, что объединение или пересечение любого конечного числа множеств принадлежит F. Говорят, что алгебра замкнута относительно конечного объединения и пересечения.

Набор подмножеств F называется сигма-алгеброй, если вместо 3) потребовать более сильное условие: чтобы объединение счетного числа множеств Ai принадлежало F: если Ai ∈ F, то ∪iAi ∈ F.

Из этого определения следует, что и пересечение счетного числа множеств принадлежит F. Иными словами, сигма-алгебра замкнута относительно счетного объединения и пересечения.

Пусть F — алгебра множеств. Функция μ, сопоставляющая любому множеству A∈F какое-нибудь неотрицательное число, называется мерой, если:

1) мера пустого множества равна 0: μ(∅) = 0;

2) для любых непересекающихся множеств A, B ∈ F, то есть A ∩ B = ∅, верно μ(A∪B) = μ(A) + μ(B). Такое свойство называется аддитивностью.

Если же взять F — сигма-алгебру, а во втором условии взять счетное количество непересекающихся множеств, то получится более сильное условие μ(∪iAi) = Σiμ(Ai), которое называется сигма-аддитивностью. Такая мера называется сигма-аддитивной.

Из определения меры следуют такие свойства:

1) если A включается в B, то мера A не больше, чем у B: если A⊆B, то μ(A) ≤ μ(B);

2) если A включается в B, то мера разности множеств равна разности мер: если A⊆B, то μ(B\A) = μ(B) — μ(A);

3) для любых A и B верно μ(A∪B)= μ(A)+ μ(B) − μ(A∩B).

Знакомые каждому примеры мер — количества (количество яблок в мешке, например), а также длины, площади, объемы фигур.

Количество элементов — так называемая считающая мера. Каждому подмножеству A поставим в соответствие количество элементов в нем: для конечных A положим μ(A) = |A|, а для бесконечных — μ(A) = ∞.

Длина на прямой, площадь на плоскости, объем в пространстве — тоже мера. Во всех случаях условие аддитивности выполняется.

Всякая ли неотрицательная числовая функция может быть мерой? Вовсе нет. Например, возраст ставит человеку в соответствие вполне определенное положительное число. Но он не подходит под определение меры. Предположение о том, что возраст может быть таковой, приводит к забавным парадоксам. Представьте себе кошку, которой пять лет. Естественно, что и правой, и левой половине животного тоже по пять лет, ведь они возникли одновременно. Если бы возраст был мерой, как, например, кошкин вес, то, согласно свойству аддитивности, кошке как сумме ее половинок должно быть уже десять лет. Подобное деление, впрочем, можно продолжить и достичь сколь угодно большого возраста. С другой стороны, мера части не может превосходить меры целого. Иначе говоря, хвост должен быть строго моложе кошки, а шерстинки на хвосте, соответственно, еще моложе. Так мы приходим к выводу, что мельчайшие клетки, из которых состоит пятилетняя кошка, должны были появиться на свет практически только что. Подобные рассуждения можно применить к таким измеримым величинам, как температура или скорость, которые не являются мерами. Два человека бегут не вдвое быстрее одного. По этому поводу в книге Артура Блоха был сформулирован закон новшества.

Если вы хотите, чтобы команда выиграла прыжки в высоту, найдите одного человека, который может прыгнуть на семь футов, а не семь человек, прыгающих на один фут.

В свою очередь, импульс (количество движения) или энергия уже обладают свойствами меры. Вес, количество денег, объем знаний, громкость (амплитуда) крика — хоть и не всегда легко измеримы, но тоже могут служить мерой на множестве людей.

Но вернемся к вероятностям. На интуитивном уровне с этим понятием знакомы сейчас практически все. Ее оценивают политологи и журналисты на ток-шоу, ее обсуждают, говоря о глобальном потеплении или завтрашнем дожде, о ней рассказывают анекдоты: «Какова вероятность встретить на Тверском бульваре живого динозавра? — Одна вторая: или встречу, или нет».

Широко распространено понимание вероятности как частоты, с которой могут происходить события при многократных испытаниях или наблюдениях. Это представление согласуется с нашим повседневным опытом, но оставляет ряд сложных вопросов. Например, когда байесовский спам-фильтр выдает следующий результат: «Вероятность того, что сообщение „Заработать в интернете может любой! Жми! Узнай как!“ — спам, составляет 82 %», с частотой чего это можно связать? Если протестировать сообщение несколько раз, ничего не изменится; можете переставить слова, но результат останется тем же, а при изменении текста сообщения мы переходим к другой задаче. О какой же вероятности речь? Другой пример. Камчатские сейсмологи каждый год публикуют прогноз сейсмической опасности — вероятности сильного землетрясения в ближайшее время. Однако и здесь неясно, можно ли дать частотное толкование такого прогноза. В мы разберемся с этим примером, а сейчас приведем определение вероятности, данное замечательным русским математиком Андреем Николаевичем Колмогоровым в 1930-е. Оно может показаться далеким от интуитивного представления и чересчур сложным. Но интуиция — неважный помощник в рассуждениях на такую абстрактную тему, как вероятность. Сформулированное Колмогоровым определение — надежный и универсальный инструмент, применимый к очень широкому кругу задач. В следующих главах мы будем неоднократно обращаться к нему, вырабатывая правильную интуицию у читателя.

Современная теория вероятностей базируется на понятии вероятностного пространства. Его определение потребует ввести несколько новых терминов.

Элементарное событие — результат какого-либо эксперимента или наблюдения за системой, имеющей случайное поведение. При этом один эксперимент порождает ровно одно событие. Например: «выпадение тройки при бросании игральной кости», «наблюдение интервала в 7 минут между автомобилями в дорожном потоке».

Множество всех таких событий называют пространством элементарных событий. Ну что же, мы теперь готовы познакомиться с тем, как в математике определяется вероятность.

Вероятностным пространством называется тройка, включающая пространство элементарных событий Ω, сигма-алгебру его подмножеств F и функцию P, называемую вероятностью, которая каждому элементу из F ставит в соответствие неотрицательное число, причем:

1) P(∅) = 0;

2) P(Ω) = 1;

3) функция P сигма-аддитивна, то есть вероятность счетного объединения непересекающихся событий равна сумме их вероятностей: P(∪iAi) = ΣiP(Ai).

Как видите, вероятность — сигма-аддитивная мера на пространстве элементарных событий, имеющем меру 1. Соответственно, описанные выше свойства меры на языке вероятностей примут следующий вид.

Если из события A следует событие B, то вероятность A не больше, чем вероятность B: если A ⊆ B, то P(A) ≤ P(B).

Если из события A следует событие B, то вероятность того, что наступит B, но не наступит A, равна разности вероятностей: если A ⊆ B, то P(B\A) = P(B) — P(A). В частности, если B = Ω, то получаем формулу для вероятности противоположного события. Если событие, означающее, что событие A не произошло, обозначить  то

то

то

то

Для любых A и B верно P(A∪B) = P(A) + P(B) − P(A∩B).

Рассмотрим простейший пример вероятностного пространства. Пусть мы бросаем монету, то есть в нашем эксперименте возможны всего два исхода, и Ω = {О (орел), Р (решка)}. Сигма-алгебра — множество всех подмножеств Ω, и в ней всего четыре элемента: {∅, {О},{Р},{О, Р}}. Она включает невозможное событие — отсутствие какого-либо результата (∅), а также тривиальное — получение какого-либо из возможных результатов {О, Р}, то есть все множество элементарных событий.

Если монета честная, то зададим такую вероятность: P(О) = 50 %, P(Р) = 50 %. Кроме того, P(∅) = 0,P(О, Р) = 100 %. Очевидно, что свойство сигма-аддитивности (которая в данном случае сводится к аддитивности) выполняется. Именно поэтому у нас получилось вероятностное пространство.

Дискретным случайным величинам соответствуют конечные или счетные множества, в них естественной (считающей) мерой оказывается обыкновенный подсчет количества элементов. Соответственно, вероятность в дискретном вероятностном пространстве получают с помощью комбинаторного подсчета вариантов, знакомого каждому студенту или интересующемуся математикой школьнику. Для непрерывных случайных величин вероятность как мера больше похожа на длину или площадь. Точное определение случайной величины мы дадим в следующей главе, пока же положимся на ее интуитивное понимание как величины, которую можно измерить или наблюдать. Но повторные измерения могут привести к иным результатам, заранее не известным.

Для полноценной работы со случайными событиями и вероятностями вводится одно важнейшее понятие, которое нехарактерно для других мер: независимость событий. С ней и связанной с нею условной вероятностью мы познакомимся в и разберемся, что же имеет в виду байесовский спам-фильтр. Впрочем, если читателю уже приходилось решать задачи, в которых появляются независимые события (например, выпадение двух «орлов» при двух подбрасываниях монеты), то он знает, что вероятность пересечения для независимых событий вычисляется как произведение их вероятностей.

Если заменить в обсуждаемых определениях и свойствах вероятности сумму на «максимум», а произведение на «минимум», можно построить альтернативную теорию. Она называется теорией возможностей. Это характерный подход для математики в целом. Начинаем с абстрактных рассуждений: числа образуют определенную структуру с операциями сложения и умножения; замечаем, что на ограниченном числовом интервале можно построить такую же числовую структуру, но с другими операциями: минимум и максимум. Строим понятие меры на новой структуре и выясняем, что она открывает новый взгляд на мир! В отличие от теории вероятностей, здесь можно построить две согласованные меры — возможность и необходимость. Это направление, созданное американцем азербайджанского происхождения Лотфи Заде, служит основанием для нечеткой логики и используется в системах автоматического распознавания образов и принятия решений.