Глава 6

Государство

Я сижу перед ноутбуком на десятом этаже складского здания в Нью-Йорке. На экране – программа, обычно используемая для цифровой криминалистики, инструмента для исследования улик и проверки информации, хранящейся на жестких дисках. Я пришла, чтобы изучить архив, содержащий самые конкретные детали того, как машинное обучение начало использоваться в разведывательном секторе под руководством некоторых из самых богатых правительств в мире. Это архив Сноудена: все документы, презентации PowerPoint, внутренние служебные записки, информационные бюллетени и технические руководства, которые бывший подрядчик АНБ и разоблачитель Эдвард Сноуден слил в 2013 году. Каждая страница помечена заголовком, отмечающим различные формы классификации. Top secret // SI // ORCON // NOFORN. Каждая из них является предупреждением и обозначением.

Кинорежиссер Лора Пойтрас впервые предоставила мне доступ к этому архиву в 2014 году. В архиве хранилось более десяти лет размышлений и сообщений разведки, включая внутренние документы Агентства национальной безопасности в США и Штаба правительственной связи в Великобритании, а также международной сети Five Eyes. Эти данные оставались недоступны для тех, кто не имел допуска высокого уровня. Они являлись частью «засекреченной империи», информации, которая, по оценкам, когда-то росла в пять раз быстрее, чем общедоступная информация. В архиве Сноудена запечатлены годы, когда сбор данных приобрел метастазы: когда телефоны, браузеры, платформы социальных сетей и электронная почта стали источниками данных для государства. Документы показывают, как разведывательное сообщество способствовало развитию многих методов, которые мы сегодня называем искусственным интеллектом.

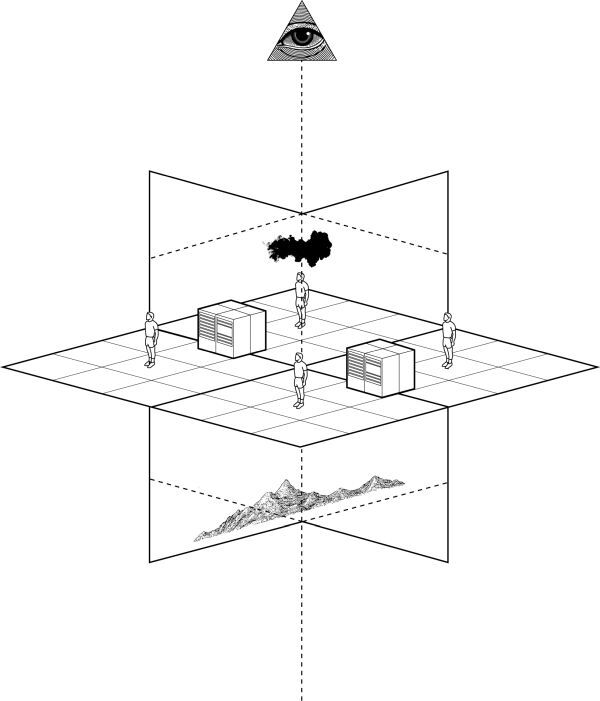

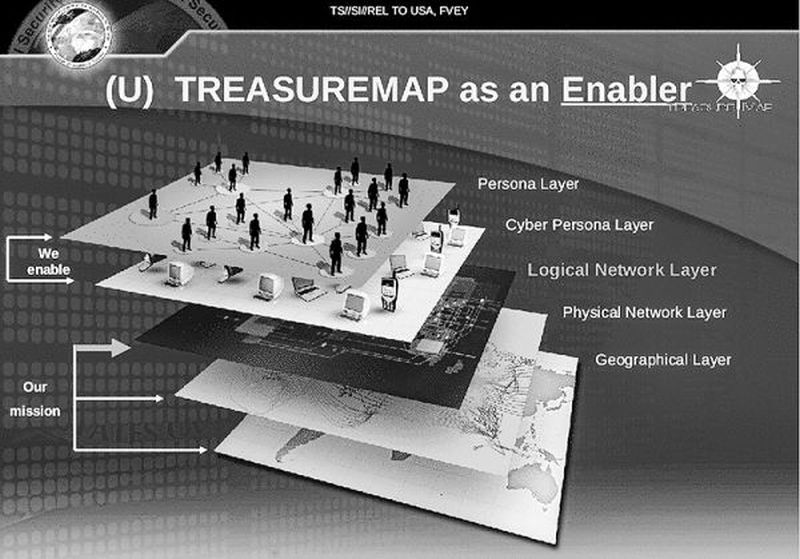

Архив Сноудена раскрывает параллельный сектор ИИ, разработанный в условиях секретности. Методы имеют много общего, но есть и разительные отличия в плане охвата, целей и результата. Исчезли любые риторические конструкции, оправдывающие извлечение и захват: каждая программная система просто описывается как нечто, чем можно завладеть, что можно победить; почти все платформы данных открыты. В одной из презентаций АНБ в PowerPoint рассказывается о программе treASuremAp, предназначенной для создания интерактивной карты интернета практически в режиме реального времени. Она утверждает, что может отслеживать местоположение и владельца любого подключенного компьютера, мобильного устройства или маршрутизатора: «Карта всего интернета – любое устройство, в любом месте, все время», – хвастается слайд. Несколько слайдов на тему «TreASuremAp как вспомогательный инструмент» предлагают анализ сигналов. Над географическим и сетевым слоями находится «слой киберперсонажей» и «слой персонажей». Слайд задуман с целью изображения всех людей, использующих подключенные устройства по всему миру, в «виде интернета с высоты 300 000 футов». Очень напоминает работу компаний по составлению карт социальных сетей и манипулированию ими, таких как Cambridge Analytica.

Документы Сноудена были обнародованы в 2013 году, но они все еще напоминают сегодняшние маркетинговые брошюры по ИИ. Если treASuremAp стал предшественником сетевого обзора Facebook, то программа под названием Foxacid напоминает Amazon Ring для домашнего компьютера: запись повседневной активности. «Если мы сможем привлечь цель посетить нас через какой-либо браузер, мы, скорее всего, сможем ей завладеть», – поясняется на слайде. После того как люди соблазняются нажать на спам или посетить веб-сайт, АНБ сбрасывает файлы через браузер, тихо сообщая обо всем, что они делают, на базу. На одном из слайдов описывается, как аналитики «разрабатывают целевые электронные письма», которые требуют «определенного уровня знаний» о цели. Ограничения на сбор АНБ секретных сведений (по крайней мере, когда речь идет о данных американских граждан) редко обсуждаются. В одном из документов отмечается, что агентство работает по нескольким направлениям, чтобы «агрессивно добиваться юридических полномочий и политической структуры, более полно отвечающей требованиям информационного века». Другими словами, меняйте законы в соответствии с инструментами, а не наоборот.

TreASuremAp, Архив Сноудена

Разведывательные службы США – это старая гвардия больших данных. Наряду с Агентством перспективных оборонных исследовательских проектов, они являются основными двигателями исследований в области ИИ с 1950-х годов. Как описывает историк науки Пол Эдвардс в книге «Закрытый мир», военные исследовательские агентства активно формировали зарождающуюся область, которая стала известна как ИИ, с первых дней ее существования. Управление военно-морских исследований, например, частично финансировало первый летний исследовательский проект по искусственному интеллекту в Дартмутском колледже в 1956 году. Область ИИ всегда определялась военной поддержкой и часто военными приоритетами, задолго до того, как стало ясно, что ИИ можно применять в больших масштабах. Как отмечает Эдвардс:

Будучи проектом с наименьшей непосредственной пользой и наиболее далеко идущими амбициями, ИИ стал необычайно сильно зависеть от финансирования ARPA. В результате ARPA стала основным покровителем первых двадцати лет исследований в области ИИ. Бывший директор Роберт Спроулл с гордостью заключил, что «целое поколение компьютерных экспертов начало свою деятельность благодаря финансированию DARPA» и что «все идеи, которые вошли в проект пятого поколения [передовых вычислительных систем][середины 1980-х годов] – искусственный интеллект, параллельные вычисления, понимание речи, программирование на естественных языках – в конечном итоге начались с исследований, финансируемых DARPA».

Военные приоритеты командования и контроля, автоматизации и наблюдения в значительной степени определили то, каким должен был стать ИИ. Инструменты и подходы, появившиеся благодаря финансированию DARPA, стали отличительной чертой этой области, включая компьютерное зрение, автоматический перевод и автономные транспортные средства. Но эти технические методы имеют более глубокие последствия. В общую логику ИИ заложены определенные виды классификационного мышления – от явно ориентированных на поле боя понятий, таких как цель, актив и обнаружение аномалий, до более тонких категорий высокого, среднего и низкого риска. Концепции постоянной ситуационной осведомленности и целеуказания будут определять исследования ИИ на протяжении десятилетий, создавая эпистемологические рамки, которые будут служить источником информации как для промышленности, так и для научных кругов.

С точки зрения государства, поворот к большим данным и машинному обучению расширил способы извлечения информации и обосновал социальную теорию слежки и понимания людей: вы узнаете их по метаданным. Кто переписывается, какие места посещает, что читает, когда и по какой причине срабатывают устройства – молекулярные действия стали видением идентификации и оценки угрозы, вины или невиновности. Сбор и измерение больших массивов данных на расстоянии стали предпочтительным способом получения предполагаемых сведений о группах и сообществах, а также оценки потенциальных целей для убийства. АНБ и ЦПС не являются уникальными – подобные агентства есть в Китае, России, Израиле, Сирии и многих других странах. Существует множество систем суверенного наблюдения и контроля, множество военных машин, которые никогда не останавливаются. Архив Сноудена подчеркивает, как государственные и корпоративные структуры сотрудничают, чтобы производить то, что Ахилл Мбембе называет «инфраструктурной войной».

Однако отношения между национальными вооруженными силами и индустрией ИИ вышли за пределы сферы безопасности. Технологии, некогда доступные только спецслужбам – внеправовые по своей сути – перешли в муниципальные руки государства: правительственные и правоохранительные органы. В то время как АНБ находится в центре внимания по вопросам конфиденциальности, меньше внимания уделяется растущему сектору коммерческого наблюдения, который агрессивно продает свои инструменты и платформы полицейским департаментам и государственным учреждениям. Индустрия ИИ одновременно бросает вызов традиционной роли государств и изменяет ее, а также используется для укрепления и расширения старых форм геополитической власти. Алгоритмическое управление одновременно является частью традиционного государственного управления и превосходит его. Перефразируя теоретика Бенджамина Браттона, можно сказать, что государство берет на себя арматуру машины, потому что машины уже взяли на себя роли и регистр государства.

Третья компенсационная стратегия

История создания интернета сосредоточилась вокруг американских военных и академических инноваций и доминирования. Но в пространстве ИИ мы видим, что не существует чисто национальной системы. Вместо этого системы ИИ функционируют в сложной переплетенной сети многонациональных и многосторонних инструментов, инфраструктур и рабочей силы. Возьмем, к примеру, систему распознавания лиц, внедренную на улицах Белграда. Директор полиции приказал установить две тысячи камер в восьмистах местах по всему городу, чтобы фиксировать лица и номерные знаки. Правительство Сербии подписало соглашение с китайским телекоммуникационным гигантом Huawei о предоставлении систем видеонаблюдения, поддержки сетей 4G, а также единых центров обработки данных и командных центров. Такие сделки – обычное дело. Местные системы часто представляют собой гибриды с инфраструктурой из Китая, Индии, США и других стран, с непроницаемыми границами, различными протоколами безопасности и потенциальными черными ходами в данных.

Вместе с тем, риторика вокруг искусственного интеллекта гораздо более резкая: нам постоянно твердят, что мы находимся в состоянии войны ИИ. Доминирующими объектами беспокойства являются наднациональные усилия США и Китая, с регулярными напоминаниями о том, что Китай заявил о своем намерении стать мировым лидером в области ИИ. Практика работы с данными ведущих технологических компаний Китая, включая Alibaba, Huawei, Tencent и ByteDance, часто оформляется как прямая политика китайского государства и, таким образом, рассматривается как более угрожающая, чем американские частные компании, такие как Amazon и Facebook, даже несмотря на то, что границы между государственными и корпоративными императивами и стимулами сложным образом переплетаются. Однако язык войны – это не просто артикуляция ксенофобии, взаимной подозрительности, международного шпионажа и взлома сетей. Как отмечают такие медиа-исследователи, как Венди Чун и Тунг Хуи Ху, либеральное видение глобальных цифровых граждан, взаимодействующих на равных в абстрактном пространстве сетей, сменилось параноидальным видением защиты национального облака от расистского врага. Призрак иностранной угрозы работает на утверждение своего рода суверенной власти над ИИ и на перераспределение локуса власти технологических компаний (которые являются транснациональными по инфраструктуре и влиянию) обратно в пределы национального государства.

Однако национализированная гонка за технологическое превосходство является одновременно риторической и реальной, создавая динамику для геополитической конкуренции между коммерческим и военным секторами и внутри них, все больше размывая между ними границы. Двойное использование приложений ИИ как в гражданской, так и в военной сфере также создало сильные стимулы для тесного сотрудничества и финансирования. В США это превратилось в явную стратегию: стремиться к национальному контролю и международному доминированию ИИ для обеспечения военного и корпоративного преимущества.

Последняя итерация этой стратегии возникла при Эше Картере, который занимал пост министра обороны США с 2015 по 2017 год. Картер сыграл важную роль в сближении Кремниевой долины с военными, убеждая технологические компании в том, что национальная безопасность и внешняя политика зависят от американского доминирования в области искусственного интеллекта. Он назвал ее «Третьей компенсационной стратегией». Под компенсацией обычно понимается способ возмещения основного военного недостатка путем изменения условий, или, как заявил бывший министр обороны Гарольд Браун в 1981 году: «Технология может стать множителем силы, ресурсом для компенсации численных преимуществ противника. Превосходная технология – это один из очень эффективных способов сбалансировать военный потенциал, не ограничиваясь сравнением потенциалов „танк за танк“ или „солдат за солдата“».

Под первой компенсирующей стратегией обычно понимают применение ядерного оружия в 1950-х годах. Вторым стал рост секретных, материально-технических и обычных вооружений в 1970-х и 1980-х годах. Третьим, по мнению Картера, должно стать сочетание искусственного интеллекта, вычислительной войны и роботов. Но в отличие от АНБ, которое уже обладало мощными возможностями наблюдения, американским военным не хватало ресурсов искусственного интеллекта, опыта и инфраструктуры ведущих технологических компаний Америки. В 2014 году заместитель министра обороны Роберт Уорк описал третью компенсацию как попытку «использовать все достижения в области искусственного интеллекта и автономии».

Для создания боевых машин с искусственным интеллектом Министерству обороны требуются гигантские добывающие инфраструктуры. Однако для того, чтобы получить доступ к высокооплачиваемой инженерной рабочей силе и сложным платформам разработки, необходимо было наладить партнерские отношения с промышленностью. АНБ проложило путь с помощью таких систем, как prISm, как работая с телекоммуникационными и технологическими компаниями, так и тайно проникая в них. Однако эти скрытые подходы столкнулись с новым политическим противодействием после разоблачений Сноудена. В 2015 году Конгресс принял Закон о свободе США, который ввел некоторые ограничения на доступ АНБ к данным Кремниевой долины в режиме реального времени. При этом возможность создания более крупного военно-промышленного комплекса вокруг данных и ИИ оставалась маняще близкой. Кремниевая долина уже создала и монетизировала логику и инфраструктуру ИИ, необходимые для новой компенсации. Но сначала нужно было убедить технологический сектор в том, что партнерство в создании инфраструктуры ведения войны будет стоить того, чтобы не оттолкнуть сотрудников и не усугубить недоверие общества.

Проект Maven

В апреле 2017 года Министерство обороны опубликовало служебную записку, объявив о создании межфункциональной группы по алгоритмической войне под кодовым названием Project Maven. «Министерство должно более эффективно интегрировать искусственный интеллект и машинное обучение во все операции, чтобы сохранить преимущества перед все более способными противниками и конкурентами», – написал заместитель министра. Целью программы являлось быстрое внедрение лучших алгоритмических систем на поле боя, даже если они были готовы лишь на 80 процентов. При этом она входила в гораздо более масштабный план – облачный проект «Объединенная инфраструктура оборонного предприятия» или JEDI – грандиозная перестройка всей ИТ-инфраструктуры Министерства обороны, от Пентагона до поддержки на местах. Проект Maven представлял собой лишь небольшой фрагмент этой большой картины, и его целью было создание системы искусственного интеллекта, которая позволила бы аналитикам выбрать цель, а затем просмотреть все существующие видеозаписи с беспилотников, на которых изображен тот же человек или транспортное средство. В конечном итоге, Министерство обороны хотело получить автоматизированную поисковую систему по видеозаписям с беспилотников для обнаружения и отслеживания вражеских комбатантов.

Официальный логотип межфункциональной команды Algorithmic Warfare под кодовым названием Project Maven. Латинский девиз переводится как «Наша работа – помогать». Предоставлено Министерством обороны США

Технические платформы и навыки машинного обучения, необходимые для Project Maven, сосредоточились в коммерческом технологическом секторе. Министерство обороны решило заплатить технологическим компаниям за анализ военных данных, собранных со спутников и боевых дронов в местах, где не действуют внутренние законы США о конфиденциальности. Благодаря такому подходу военные и финансовые интересы американского технологического сектора в области ИИ смогли бы сблизить свои интересы, не вызывая при этом конституционных споров о неприкосновенности частной жизни, как это делало Агентство национальной безопасности. Среди технологических компаний, которые хотели получить контракт на Maven, началась война торгов, включая Amazon, Microsoft и Google.

Первый контракт по проекту Project Maven достался компании Google. Согласно договору, Пентагон должен был использовать инфраструктуру ИИ TensorFlow компании Google для просмотра отснятого беспилотниками материала и обнаружения объектов и отдельных лиц в процессе их перемещения между точками.. Фей-Фей Ли, в то время главный научный сотрудник отдела ИИ/МЛ в Google, уже стала экспертом в создании наборов данных для распознавания объектов, учитывая ее опыт создания ImageNet и использования спутниковых данных для обнаружения и анализа автомобилей. Но она была непреклонна в том, что проект следует держать в секрете. «Избегайте любых упоминаний или намеков на ИИ», – написала Ли в электронном письме коллегам из Google, которое позже попало в сеть. «Оружейный ИИ – это, вероятно, одна из самых чувствительных тем в данной области – если не самая. Это „красная тряпка“ для СМИ, и она найдут любые способы в попытке навредить Google».

Впрочем, в 2018 году сотрудники Google узнали о масштабах роли компании в проекте. Их взбесил тот факт, что их работа используется в военных целях, особенно после того, как стало известно, что цели проекта Maven по идентификации изображений включают такие объекты, как транспортные средства, здания и людей. Более 3100 сотрудников подписали письмо протеста, где заявили, что Google не должна заниматься военными делами, и потребовали аннулировать контракт. Под растущим давлением Google официально прекратила работу над проектом Project Maven и вышла из конкурса на десятимиллиардный контракт Пентагона JEDI. В октябре того же года президент Microsoft Брэд Смит заявил в блоге: «Мы верим в сильную оборону Соединенных Штатов и хотим, чтобы люди, которые ее защищают, имели доступ к лучшим технологиям страны, в том числе от Microsoft». В конечном итоге контракт достался Microsoft, которая перебила цену Amazon.

Вскоре после внутреннего восстания компания Google опубликовала Принципы искусственного интеллекта, которые включали раздел о «приложениях ИИ, разработкой которых мы не будем заниматься». К ним относилось создание «оружия или других технологий, основной целью или применением которых является причинение или прямое содействие причинению вреда людям», а также «технологий, которые собирают или используют информацию для слежки с нарушением международно признанных норм». Хотя обращение к этике ИИ сняло некоторые внутренние и внешние опасения, возможность применения и параметры этических ограничений остались неясными.

В ответ бывший генеральный директор Google Эрик Шмидт охарактеризовал реакцию на проект Maven как «общую озабоченность технологического сообщества тем, что военно-промышленный комплекс использует наши разработки для неправильного убийства людей, если там можно сказать». Этот переход от дебатов о том, стоит ли вообще использовать ИИ в военных действиях, к дебатам о том, может ли ИИ помочь «правильно убивать людей», оказался весьма стратегическим. Он переместил фокус с фундаментальной этики ИИ как военной технологии на вопросы точности и технической аккуратности. Люси Сачман, однако, утверждает, что проблемы автоматизированной войны выходят далеко за рамки точности или «правильности» убийства. В частности, в случае обнаружения объектов, спрашивает Сачман, кто создает обучающие наборы и какие данные он использует? Каким образом объекты классифицируются как угроза? Что является достаточно аномальной активностью, чтобы вызвать законную атаку беспилотника? И почему мы должны оправдывать приписывание последствий для жизни и смерти этим нестабильным и по своей сути политическим классификациям?

Эпизод с Maven, а также появившиеся принципы ИИ указывают на глубокие разногласия в индустрии ИИ по поводу отношений между военной и гражданской сферами. Война ИИ, как реальная, так и воображаемая, насаждает политику страха и незащищенности, которая создает климат, используемый для подавления внутреннего несогласия и беспрекословной поддержки националистической повестки дня. После того, как Maven исчез с горизонта, главный юридический директор Google Кент Уокер заявил, что компания стремится получить более высокие сертификаты безопасности и тесно сотрудничать с Министерством обороны. «Я хочу внести ясность, – сказал он. – Мы – гордая американская компания». Ставя патриотизм на уровень политики, технологические компании все чаще заявляют о своей приверженности интересам национального государства, даже когда их платформы и возможности превосходят традиционное государственное управление.

Аутсорсинговое государство

Отношения между государством и индустрией ИИ выходят далеко за рамки национальных вооруженных сил. Технологии, которые раньше предназначались для военных зон и шпионажа, теперь используются на местном уровне управления, от агентств социального обеспечения до правоохранительных органов. Этому сдвигу способствовал аутсорсинг ключевых функций государства технологическим подрядчикам. На первый взгляд, это не сильно отличается от обычного аутсорсинга государственных функций в частный сектор такими компаниями, как Lockheed Martin или Halliburton. Но теперь милитаризованные формы выявления шаблонов и оценки угроз переходят в масштабах муниципальных служб и учреждений. Значительным примером этого явления является компания, названная в честь волшебных камней из «Властелина колец»: Palantir.

Компания Palantir была основана в 2004 году, ее соучредителем стал миллиардер из PayPal Питер Тиль, который также выступал советником и финансовым сторонником президента Трампа. Позже Тиль в своей статье утверждал, что ИИ – это прежде всего военная технология: «Забудьте о фантастике; что является мощным в реально существующем ИИ, так это его применение к относительно обыденным задачам, таким как компьютерное зрение и анализ данных. Хотя эти инструменты и менее жуткие, чем монстр Франкенштейна, они, тем не менее, ценны для любой армии, например, для получения преимущества в разведке… Несомненно, инструменты машинного обучения имеют и гражданское применение».

Хотя Тиль признает невоенное применение машинного обучения, он особенно верит в промежуточное пространство: когда коммерческие компании производят инструменты военного образца и предоставляются всем, кто хочет получить преимущество в разведке и готов за это платить. И он, и генеральный директор Palantir Алекс Карп называют Palantir «патриотической», а Карп обвиняет другие технологические компании, которые отказываются работать с военными ведомствами, в «пограничном безрассудстве». В своем проницательном эссе писательница Мойра Вайгель изучила университетскую диссертацию Карпа, которая раскрывает его ранний интеллектуальный интерес к агрессии и веру в то, что «желание совершить насилие является постоянным основополагающим фактом человеческой жизни». Диссертация Карпа называлась «Агрессия в мире под названием Жизнь».

Первоначальными клиентами Palantir являлись федеральные военные и разведывательные ведомства, включая Министерство обороны, Агентство национальной безопасности, ФБР и ЦРУ. Как показало расследование, после вступления Трампа в должность президента сумма контрактов Palantir с американскими ведомствами превысила миллиард долларов. Однако компания Palantir не считалась типичным оборонным подрядчиком в духе Lockheed Martin. Она приняла характер стартапа из Кремниевой долины, базируясь в Пало-Альто и собрав в штат преимущественно молодых инженеров, и была поддержана In-Q-Tel, фирмой венчурного капитала, финансируемой ЦРУ. Помимо первых клиентов из разведывательных служб, Palantir начала работать с хедж-фондами, банками и такими корпорациями, как Walmart. Но при этом ее ДНК формировалась в процессе работы на оборонное сообщество и внутри него. Она использовала те же подходы, о которых говорится в документах Сноудена, включая извлечение данных с устройств и проникновение в сети для отслеживания и оценки людей и активов. Palantir быстро стала предпочтительным поставщиком услуг слежения, включая разработку баз данных и программного обеспечения для управления механикой депортации для Иммиграционной и таможенной полиции (ICE).

Бизнес-модель Palantir основана на сочетании анализа данных и выявления закономерностей с помощью машинного обучения в сочетании с более общим консалтингом. Palantir направляет инженеров в компанию, которые извлекают широкий спектр данных – электронную почту, журналы звонков, социальные сети, когда сотрудники входят и выходят из зданий, когда они заказывают билеты на самолет, все, чем компания готова поделиться, – а затем ищут закономерности и дают советы о том, что делать дальше. Одним из распространенных подходов является поиск действующих или потенциальных «плохих агентов» – недовольных сотрудников, которые могут слить информацию или обмануть компанию. Мировоззрение, лежащее в основе инструментов Palantir, напоминает АНБ: собирайте все, а затем ищите аномалии в данных. Однако если инструменты АНБ созданы для наблюдения и нацелены на врагов государства в обычной или тайной войне, то подход Palantir направлен против гражданских лиц. Как говорилось в масштабном расследовании Bloomberg в 2018 году, Palantir – это «разведывательная платформа, созданная для глобальной войны с террором», которая теперь «используется в качестве оружия против обычных американцев у себя дома»: Palantir работала на Пентагон и ЦРУ в Афганистане и Ираке… Министерство здравоохранения и социального обеспечения США использует Palantir для выявления мошенничества в программе Medicare. ФБР использует его при расследовании уголовных дел. Министерство внутренней безопасности использует его для проверки авиапассажиров и слежки за иммигрантами.

Вскоре слежка за работниками без документов переросла в отлов и депортацию людей в школах и на рабочих местах. Для достижения этой цели компания Palantir выпустила приложение для телефона под названием fAlCON, которое функционирует как огромный невод, собирая данные из многочисленных правоохранительных и государственных баз данных, где указаны иммиграционные истории людей, семейные отношения, информация о работе и учебных заведениях. В 2018 году агенты ICE использовали fAlCON для проведения рейда против почти сотни компаний 7-Eleven по всей территории США, что было названо «крупнейшей операцией против одного работодателя в эпоху Трампа».

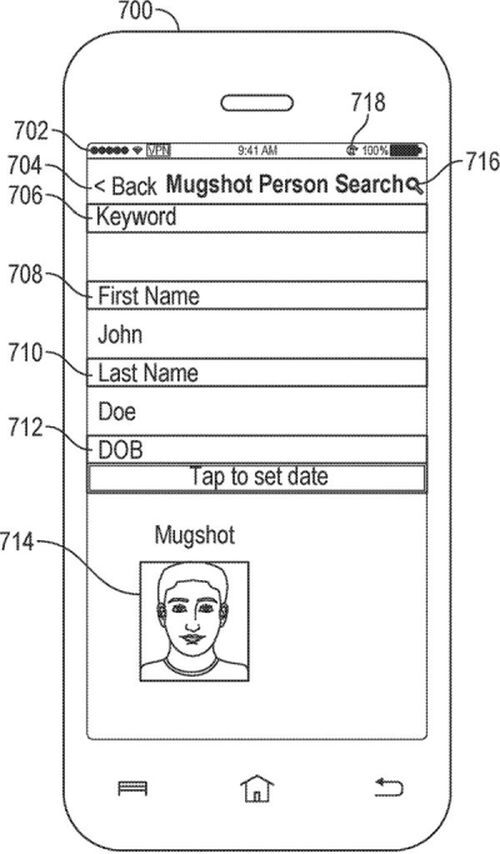

Несмотря на усилия Palantir по сохранению тайны о разработках и принципах работы систем, патентные заявки компании дают нам некоторое представление о ее подходе к ИИ. В заявке под безобидным названием «Системы баз данных и пользовательские интерфейсы для динамического и интерактивного анализа и идентификации мобильных изображений» Palantir хвастается способностью приложения фотографировать людей в короткие промежутки времени и, независимо от того, находятся ли они под подозрением или нет, сверять их изображения со всеми доступными базами данных. По сути, система использует распознавание лиц и обратную обработку для создания основы, на которой можно основывать арест или депортацию.

Изображение из патента компании Palantir US10339416B2. Предоставлено Ведомством по патентам и товарным знакам США

Хотя системы Palantir имеют структурное сходство с системами АНБ, они перешли на уровень местных сообществ, чтобы их продавали как сетям супермаркетов, так и местным правоохранительным органам. Это представляет собой сдвиг от традиционной полицейской деятельности к целям, которые больше ассоциируются с инфраструктурой военной разведки. Как объясняет профессор права Эндрю Фергюсон, «мы движемся к состоянию, когда прокуроры и полицейские будут говорить: „Алгоритм сказал мне сделать это, и я сделал, не имея ни малейшего представления о том, что я делаю“. И это будет происходить на повсеместном уровне при очень слабом надзоре».

Социолог Сара Брейн является одним из первых ученых, непосредственно наблюдавших за тем, как платформы данных Palantir используются на деле, в частности, в полицейском управлении Лос-Анджелеса. Проведя более двух лет вместе с полицейскими во время патрулирования, наблюдая за их работой и проводя многочисленные интервью, Брейн пришла к выводу, что в некоторых областях эти инструменты просто усиливают прежнюю полицейскую практику, но в других случаях они полностью меняют процесс наблюдения. Короче говоря, полиция превращается в агентов разведки:

Переход от традиционного наблюдения к наблюдению с использованием объемных данных связан с миграцией правоохранительных операций в сторону разведывательной деятельности. Основное различие между правоохранительной и разведывательной деятельностью заключается в следующем: правоохранительные органы, как правило, начинают действовать после того, как произошел криминальный инцидент. По закону, полиция не может проводить обыск и собирать личную информацию до тех пор, пока не появится достаточное основание. Разведка, напротив, в основе своей имеет прогностический характер. Разведывательная деятельность включает в себя сбор данных, выявление подозрительных моделей, мест, деятельности и лиц, а также упреждающее вмешательство на основе полученных данных.

Хотя все подвергаются подобному наблюдению, некоторые люди сталкиваются с ним чаще, чем другие: иммигранты, люди без документов, бедные и цветные сообщества. Как заметила Брейн в своем исследовании, использование программного обеспечения Palantir воспроизводит неравенство, делая жителей преимущественно бедных, черных и латиноамериканских районов еще более подверженными слежке. Система баллов Palantir придает ауру объективности: это «просто математика», по словам одного полицейского. Но она создает усиливающуюся логическую петлю. Брейн пишет:

Несмотря на заявленное намерение системы баллов избежать юридически оспоримой предвзятости в действиях полиции, она скрывает как преднамеренную, так и непреднамеренную необъективность и создает самоподдерживающийся цикл: если люди имеют высокий балл, они находятся под усиленным наблюдением и, следовательно, имеют большую вероятность быть остановленными, что еще больше увеличивает их балл. Такая практика затрудняет дальнейшее вовлечение в сеть наблюдения лиц, уже находящихся в системе уголовного правосудия, и одновременно затушевывает роль правоприменительной практики в формировании оценок риска.

Машинное обучение, применяемое Palantir и ему подобными, способно привести к возникновению обратной связи: лица, включенные в базу данных уголовного правосудия, с большей вероятностью окажутся под наблюдением, а значит, с большей вероятностью о них будет получена дополнительная информация, что оправдывает дальнейшую проверку со стороны полиции. Неравенство не только углубляется, но и вымывается технологиями, оправдываясь системами, которые кажутся невосприимчивыми к ошибкам, но на самом деле усиливают проблемы чрезмерного полицейского контроля и расово предвзятого наблюдения. Модели разведки, зародившиеся в национальных правительственных агентствах, теперь стали частью полицейской работы в местных районах. Внедрение АНБ в полицейские департаменты усугубляет историческое неравенство, радикально трансформирует и расширяет практику работы полиции.

Несмотря на массовое расширение государственных контрактов на системы искусственного интеллекта, вопросу о том, должны ли частные поставщики этих технологий нести юридическую ответственность за вред, причиняемый правительствами при использовании их систем, уделяется мало внимания. Учитывая, как часто правительства обращаются к подрядчикам для создания алгоритмических архитектур в процессе принятия государственных решений, будь то полицейская деятельность или системы социального обеспечения, есть основания полагать, что такие технологические поставщики, как Palantir, должны нести ответственность за дискриминацию и другие нарушения. В настоящее время большинство государств пытаются снять с себя ответственность за проблемы, создаваемые системами искусственного интеллекта, аргументируя это тем, что «мы не можем отвечать за то, чего не понимаем». Это означает, что коммерческие алгоритмические системы вносят свой вклад в процесс принятия государственных решений без значимых механизмов подотчетности. Вместе с правоведом Джейсоном Шульцем я утверждаю, что разработчики систем искусственного интеллекта, которые напрямую влияют на принятие государственных решений, должны считаться участниками этого процесса с целью конституционной ответственности. То есть, они, как и государства, могут быть признаны юридически ответственными за причинение вреда. До этого момента у поставщиков и подрядчиков фактически нет мотивации следить за тем, чтобы их системы не усиливали исторический вред и не создавали совершенно новый.

Другим примером этого явления является компания Vigilant Solutions, основанная в 2005 году. Компания работает на основе единственной предпосылки: взять инструменты наблюдения, которые в случае государственного управления могли бы потребовать судебного надзора, и превратить их в процветающее частное предприятие за пределами конституционных ограничений конфиденциальности. Компания Vigilant начала свою деятельность в нескольких городах США с установки камер автоматического распознавания номерных знаков (ALPR), размещая их везде – от автомобилей до фонарных столбов, от парковок до жилых домов. Этот массив сетевых камер фотографирует каждый проезжающий автомобиль, сохраняя изображения номерных знаков в обширной базе данных. Затем компания Vigilant продает доступ к базе полиции, частным детективам, банкам, страховым компаниям и другим желающим. Если полицейские хотят отследить автомобиль по всему штату и отметить все места, где он побывал, Vigilant может предоставить такую информацию. Аналогичным образом, если банк захочет вернуть автомобиль, Vigilant покажет, где он находится, – за определенную плату.

Калифорнийская компания Vigilant рекламирует себя как «один из надежных инструментов борьбы с преступностью, помогающий правоохранительным органам быстрее находить зацепки и раскрывать правонарушения». Компания заключила партнерство с рядом правительств в Техасе, Калифорнии и Джорджии, чтобы предоставить полиции набор систем ALPR для использования в патрулировании, а также доступ к базе данных Vigilant. В свою очередь, местные органы власти предоставляют Vigilant записи о непогашенных штрафах разного рода. Все номерные знаки, отмеченные в базе данных как соответствующие задолженностям по штрафам, поступают в мобильные системы полицейских, что позволяет им останавливать водителей. Водителям же предлагается два варианта: оплатить штраф на месте или быть арестованными. Помимо 25-процентной надбавки, компания Vigilant ведет учет считывания каждого номерного знака и извлекает эти данные для пополнения своих обширных баз.

Vigilant подписала важный контракт с ICE, предоставляющий агентству доступ к пяти миллиардам записей номерных знаков, собранных частными компаниями, а также к 1,5 миллиардам точек данных, переданных 80 местными правоохранительными органами по всей территории США – включая информацию о том, где живут и работают люди. Эти данные могут быть получены в результате неформальных договоренностей между местной полицией и ICE и могут нарушать законы штатов об обмене информацией. Собственная политика конфиденциальности ICE ограничивает сбор данных вблизи «чувствительных мест», таких как школы, церкви и места проведения акций протеста. Но в данном случае ICE не собирает информацию и не ведет базу: агентство просто покупает доступ к системам Vigilant, которые имеют гораздо меньше ограничений. Это де-факто приватизация государственного наблюдения, размывание границ между частными владельцами и государственными структурами, и это создает непрозрачные формы сбора данных, которые живут вне традиционных правил защиты.

Впоследствии Vigilant расширила свой набор инструментов для «раскрытия преступлений», не ограничиваясь считывателями номерных знаков, но и включив в него устройства, способные распознавать лица. При этом Vigilant стремится сделать их эквивалентом номерных знаков, а затем вернуть в экологию полицейского контроля. Подобно сети частных детективов, Vigilant создает «всевидящее око», глядящее на переплетение дорог и магистралей Америки, а также на всех, кто по ним путешествует, оставаясь при этом вне любой значимой формы регулирования или подотчетности.

Если мы переместимся от полицейской машины к крыльцу дома, то увидим еще одно место, где стираются различия между практикой работы с данными в государственном и частном секторах. Новое поколение социальных медиа-приложений, таких как Neighbors, Citizen и Nextdoor, позволяет пользователям получать уведомления о местных происшествиях в режиме реального времени, затем обсуждать их, а также транслировать, делиться и отмечать записи с камер наблюдения. Система Neighbors, созданная компанией Amazon и использующая камеры дверного звонка Ring, определяет себя как «новый соседский дозор» и классифицирует отснятый материал по таким категориям, как «Преступление», «Подозрительный» или «Незнакомец». Видеозаписи с их камер часто передаются в полицию. В этих экосистемах наблюдения за жильем логика Treasuremap и Foxacid соединяется, но соединяется с домом, улицей и всеми промежуточными местами.

Что касается Amazon, то каждое новое проданное устройство Ring помогает ей создать еще более масштабные обучающие базы данных внутри и вне дома, с классификационными логиками нормального и аномального поведения, согласованными с логиками союзников и врагов на поле боя. Одним из примеров является функция, с помощью которой пользователи могут сообщать о краже посылок Amazon. Согласно одному журналистскому расследованию, многие сообщения содержали расистские комментарии, а видеозаписи непропорционально часто изображали цветных людей как потенциальных воров. Помимо сообщений о преступлениях, Ring также используется для сообщений о сотрудниках Amazon, которые, по мнению пользователей, плохо работают, например, недостаточно аккуратно обращаются с посылками.

Чтобы завершить государственно-частную инфраструктуру наблюдения, Amazon активно продвигает систему Ring среди полицейских департаментов, предоставляя им скидки и предлагая портал, который позволяет полиции видеть, где расположены камеры Ring и напрямую связываться с владельцами домов, чтобы запросить видеозаписи в неофициальном порядке. Amazon заключила партнерство по обмену видеозаписями Ring с более чем шестью сотнями полицейских участков.

В одном из случаев компания Amazon заключила договор с полицейским департаментом во Флориде, который был обнаружен в результате запроса, поданного журналисткой Кэролайн Хаскинс. Он показал, что полиция была заинтересована в продвижении приложения Neighbors, и за каждую соответствующую загрузку получала бонусы на бесплатные камеры Ring. «В результате возникла целая цепочка: больше людей скачивают Neighbors, больше людей получают Ring, записи с камер наблюдения распространяются, а полиция может запрашивать все, что захочет», – пишет Хаскинс Возможности наблюдения, которые когда-то были запрещены судами, теперь предлагаются в Apple App Store и продвигаются местными уличными полицейскими. Как отмечает исследователь СМИ Тунг-Хуи Ху, используя такие приложения, мы «становимся внештатными сотрудниками государственного аппарата безопасности».

Ху описывает, что таргетинг – квинтэссенция милитаристского термина – во всех его формах должен рассматриваться как единая взаимосвязанная система власти: от таргетированной рекламы до подозрительных соседей и беспилотников. «Мы не можем просто рассматривать одну форму в отрыве от другой; объединенные суверенитетом данных, они призывают нас по-другому понимать власть в эпоху облачных технологий». Способы наблюдения, которые когда-то являлись прерогативой исключительно спецслужб, теперь гранулированы и рассеяны по многим социальным системам – встроены в рабочие места, дома и автомобили – и продвигаются технологическими компаниями, которые живут в перекрестных пространствах, пересекающих коммерческий и военный секторы ИИ.

От кредитных до террористических и социальных рейтингов

В основе военной логики таргетинга лежит идея сигнатуры. Ближе к концу второго срока президента Джорджа Буша-младшего ЦРУ заявило, что оно должно иметь возможность наносить удары беспилотниками, основываясь исключительно на наблюдаемой «модели поведения» или «сигнатуре» человека. Если «удар по цели» предполагает нападение на конкретное лицо, то «удар по сигнатуре» – это когда человека убивают из-за его метаданных; другими словами, его личность неизвестна, но данные указывают на то, что он может быть террористом. Как показали документы Сноудена, в годы правления Обамы глобальная программа наблюдения за метаданными Агентства национальной безопасности геолокализировала SIM-карту или телефон подозреваемого, а затем американские военные наносили удары беспилотниками, чтобы убить человека, владеющего этим устройством. «Мы убиваем людей на основе метаданных», – сказал генерал Майкл Хайден, бывший директор АНБ и ЦРУ. Подразделение АНБ Geo Cell использовало более красочные выражения: «Мы их отслеживаем, а вы их убиваете».

Сигнатурные атаки могут показаться точными и подразумевающими подлинную метку чьей-то личности. Однако в 2014 году юридическая организация Reprieve опубликовала доклад, где показала, что удары беспилотников, пытавшихся уничтожить 41 человека, привели к гибели примерно 1147 лиц. Беспилотники были проданы американской общественности под предлогом их «точности». Но они точны лишь настолько, насколько точны разведданные, которые их питают, – сказала Дженнифер Гибсон, возглавлявшая отчет. Форма сигнатурного удара не связана с точностью: она связана с корреляцией. Как только в данных обнаруживается закономерность и она достигает определенного порога, подозрений становится достаточно для принятия мер даже при отсутствии окончательных доказательств. Такой способ вынесения решения путем распознавания образов встречается во многих областях – чаще всего в форме оценки.

Рассмотрим пример кризиса сирийских беженцев 2015 года. Миллионы людей спасались от широкомасштабной гражданской войны и вражеской оккупации в надежде найти убежище в Европе. Беженцы рисковали жизнью на плотах и переполненных лодках. 2 сентября трехлетний мальчик по имени Алан Курди утонул в Средиземном море вместе со своим пятилетним братом, когда их лодка перевернулась. Фотография его тела, выброшенного на пляж в Турции, попала в заголовки международных газет, став мощным символом масштабов гуманитарного кризиса: одно изображение заменяет весь ужас в целом. Но некоторые увидели в этом растущую угрозу. Примерно в это время к IBM обратились с предложением о новом проекте. Может ли компания использовать свою платформу машинного обучения для выявления данных беженцев, которые могут быть связаны с джихадизмом? Короче говоря, может ли IBM автоматически отличить террориста от беженца?

Эндрю Борен, руководитель стратегических инициатив в IBM, рассказал о причинах программы военному изданию Defense One: «Наша международная команда и некоторые из сотрудников в Европе получали сообщения о том, что среди голодных и обездоленных беженцев находились мужчины призывного возраста в крепком здоровье. Является ли это поводом для беспокойства в отношении ИГИЛ, и если да, то может ли такое решение быть полезным?».

Находясь на безопасном расстоянии от своих корпоративных офисов, специалисты IBM по обработке данных рассматривали проблему как решаемую с помощью извлечения данных и анализа социальных сетей. Оставив в стороне множество переменных, существующих в условиях временных лагерей беженцев, и десятки предположений, используемых для классификации поведения террористов, IBM создала экспериментальный «рейтинг террористов», чтобы отсеять боевиков ИГИЛ от беженцев. Аналитики собрали множество неструктурированных данных, от Twitter до официального списка тех, кто утонул вместе с множеством перевернувшихся лодок у берегов Греции и Турции. Они также составили базу данных по образцу пограничников. Из разрозненных показателей они составили гипотетический балл угрозы: не абсолютный показатель вины или невиновности, отметили они, а глубокое «понимание» личности, включая прошлые адреса, места работы и социальные связи. Между тем, сирийские беженцы не знали, что их личные данные собираются для испытания системы, которая может выделить их как потенциальных террористов.

Это лишь один из многих случаев, когда новые технические системы государственного контроля используют беженцев в качестве тестовых образцов. Эти военные и полицейские логики пропитаны одной из форм финансиализации: социально выстроенные модели кредитоспособности вошли во многие системы искусственного интеллекта, влияя на все – от возможности получить кредит до разрешения пересечь границу. В настоящее время по всему миру, от Китая до Венесуэлы и США, используются сотни таких платформ, поощряющих заранее определенные формы социального поведения и наказывающих тех, кто им не соответствует. Этот «новый режим морализованной социальной классификации», по словам социологов Марион Фуркад и Кирана Хили, приносит выгоду «высокостоящим» представителям традиционной экономики, в то время как наименее привилегированные слои населения оказываются в еще более невыгодном положении. Кредитный рейтинг, в самом широком смысле, стал местом, где сочетаются военные и коммерческие подписи.

Подобная логика оценки ИИ глубоко вплетена в правоохранительную деятельность и пограничный контроль, традиционные сферы деятельности государства, но кроме того она лежит и в основе другой государственной функции: доступа к общественным благам. Как показывает политолог Вирджиния Юбэнкс в своей книге «Автоматизация неравенства», когда системы ИИ внедряются в рамках государства всеобщего благосостояния, они используются в основном как способ наблюдения, оценки и ограничения доступа людей к государственным ресурсам, а не как способ обеспечения большей поддержки.

Ключевым примером этой динамики послужил случай, когда бывший губернатор-республиканец штата Мичиган Рик Снайдер, ранее занимавший пост председателя совета директоров компании компьютерного оборудования Computer Gateway, решил реализовать две алгоритмически управляемые программы жесткой экономии в попытке подорвать экономическую безопасность своих беднейших граждан под эгидой сокращения государственного бюджета. Во-первых, он распорядился использовать алгоритм подбора для реализации политики штата в отношении «беглых преступников», которая автоматически лишала людей права на получение продовольственной помощи на основании непогашенных штрафов. В период с 2012 по 2015 год новая система неточно сопоставила данные более чем девятнадцати тысяч жителей Мичигана и автоматически лишила каждого из них продовольственной помощи.

Вторая схема называлась Мичиганская интегрированная автоматизированная система данных (MiDAS) – система, созданная для вынесения «робо-решений» и наказания тех, кто, по ее мнению, обманывает государственное страхование по безработице. MiDAS была разработана таким образом, что практически любые несоответствия данных или противоречия в записях о человеке рассматривались как потенциальное доказательство незаконного поведения. Система неточно определила более сорока тысяч жителей Мичигана, подозреваемых в мошенничестве. Последствия оказались тяжелыми: изъятие возвращенных налогов, наложение ареста на заработную плату и наложение гражданских штрафов, которые в четыре раза превышали сумму долга, предъявленную людям. В конечном итоге обе системы оказались гигантскими финансовыми провалами и стоили Мичигану гораздо больше денег, чем удалось сэкономить. Пострадавшие смогли успешно отсудить у штата деньги за эти системы, но не раньше, чем тысячи людей пострадали, а многие из них стали банкротами.

Рассматривая в общем контексте государственные системы искусственного интеллекта, можно заметить последовательную логику между преследованием террористов или работников без документов и преследованием беглых преступников или подозреваемых мошенников. Несмотря на то, что продовольственная помощь и пособия по безработице создавались для поддержки бедных и содействия социальной и экономической стабильности, использование милитаристских систем командования и контроля для целей наказания и исключения подрывает общие цели этих систем. По сути, эти системы являются карательными, созданными по модели «угроза-цель». Мотивы оценки и риска глубоко проникли в структуры государственной бюрократии, а автоматизированные системы принятия решений, созданные в этих учреждениях, глубоко внедряют эту логику в то, как представляются, оцениваются и обслуживаются сообщества и отдельные люди.

Иголка в стоге сена

Я уже почти закончила долгий день, просматривая архив Сноудена, когда вдруг наткнулась на слайд, описывающий планету как «стог информации», где желаемые сведения – это иголка, затерявшаяся где-то среди соломы. Он включает в себя веселый клип-арт, изображающий гигантский стог сена в поле с голубым небом над головой. Это клише сбора информации носит тактический характер: сено косят для блага фермы, собирают, чтобы получить прибыль. Это вызывает успокаивающий пасторальный образ сельского хозяйства данных – уход за полями для дальнейшего упорядоченного цикла добычи и производства. Фил Агре однажды заметил, что «технология в настоящее время – это скрытая философия; смысл в том, чтобы сделать ее открыто философской». Философия здесь заключается в том, что данные должны добываться в глобальном масштабе и структурироваться для поддержания гегемонии США. Однако мы уже видели, как эти истории распадаются при тщательном изучении.

Пересекающиеся сетки планетарных вычислений – это сложные, перекрещивающиеся корпоративные и государственные логики, выходящие за пределы традиционных государственных границ и пределов управления, и они гораздо беспорядочнее, чем может показаться. Как утверждает Бенджамин Браттон, «арматура вычислений планетарного масштаба имеет определяющую логику, которая является самоподкрепляющейся, если не самореализующейся, и которая благодаря автоматизации собственных инфраструктурных операций превосходит любые национальные проекты, даже если она также используется от их имени». Идея суверенного ИИ, надежно удерживаемого в пределах национальных границ, – это миф. Инфраструктура ИИ уже является гибридной, и, как утверждает Ху, рабочая сила, лежащая в ее основе, – от китайских рабочих, производящих электронные компоненты, до российских программистов, обеспечивающих работу в облаке, и марокканских фрилансеров, отбирающих контент и маркирующих изображения.

В совокупности ИИ и алгоритмические системы, используемые государством, от военного до муниципального уровня, раскрывают скрытую философию массового инфраструктурного командования и контроля с помощью комбинации методов извлечения данных, логики таргетинга и наблюдения. Эти цели были центральными для разведывательных служб на протяжении десятилетий, но теперь они распространились на многие другие государственные функции, от охраны правопорядка на местах до распределения льгот. Это лишь часть глубокого переплетения государственной, муниципальной и корпоративной логики в рамках планетарных вычислений. Впрочем, эта сделка довольно неудобная: государства заключают сделки с технологическими компаниями, которые они не могут контролировать или даже полностью понимать, а технологические компании берут на себя государственные и внегосударственные функции, которые они не приспособлены выполнять и за которые в какой-то момент в будущем они могут быть привлечены к ответственности.

Архив Сноудена демонстрирует, насколько далеко простирается пересекающаяся и противоречивая логика слежки. В одном из документов отмечаются признаки того, что сотрудник АНБ описал как зависимость от «всевидящего ока»: «Альпинисты называют это явление „лихорадкой вершины“ – когда „человек становится настолько зациклен на достижении пика, что все остальное исчезает из сознания“». Я считаю, что SIGINT, как и альпинисты мирового класса, не застрахованы от лихорадки вершин. Достаточно легко потерять из виду плохую погоду и неустанно двигаться вперед, особенно после того, как вложил в какое-то дело много денег, времени и ресурсов.

Все деньги и ресурсы, потраченные на неустанную слежку, являются частью лихорадочной мечты о централизованном контроле, который был достигнут ценой других видений социальной организации. Разоблачения Сноудена стали переломным моментом, показавшим, насколько далеко может зайти культура извлечения информации при сотрудничестве государства и коммерческого сектора, хотя сетевые диаграммы и клип-арт PowerPoint могут показаться причудливыми по сравнению со всем, что произошло с тех пор. Отличительные методы и инструменты АНБ проникли в классы, полицейские участки, на рабочие места и в бюро по трудоустройству. Это результат огромных инвестиций, фактических форм приватизации и секьюритизации риска и страха. Нынешнее глубокое переплетение различных форм власти представляло собой надежду Третьей Компенсации. Оно вышло далеко за рамки цели стратегического преимущества в операциях на поле боя и охватило все те стороны повседневной жизни, которые можно отследить и оценить, основываясь на нормативных определениях того, как хорошие граждане должны общаться, вести себя и тратить деньги. Этот сдвиг несет с собой иное видение государственного суверенитета, модулируемого корпоративным алгоритмическим управлением, и усиливает глубокий дисбаланс власти между представителями государства и людьми, которым они призваны служить.