Языковая игра

Существует и такая языковая игра: изобретать имя для чего-нибудь.

ЛЮДВИГ ВИТГЕНШТЕЙН

Мне неоднократно приходилось слышать такого рода возражения: мол, какой у машины может быть интеллект? Это же просто набор алгоритмов, созданных человеком!

Забавно. Да, есть и «бузина», и «в Киеве дядька» тоже может быть, но слово – это только слово, и в зависимости от контекста оно может обозначать совершенно разные вещи.

Недаром мой любимый философ Людвиг Витгенштейн говорил, что не существует никаких «философских проблем», а есть лишь неразрешённые «языковые игры».

Проще говоря, если вы разберётесь, в каких словах вы запутались, то и проблемы, скорее всего, исчезнут сами собой.

Автором магического теперь уже словосочетания «искусственный интеллект» по праву считается Джон Маккарти. Но не от хорошей жизни искусственный интеллект стал «искусственным интеллектом». Придумать название для чего-то, чего раньше никогда не было, но чтобы любой человек, по системе ассоциаций, быстро понимал, о чём идёт речь, – это непросто очень.

Маккарти понимал, что есть феномен, который нуждается в номинации – в назывании. Об этом феномене рассуждали в 40-50-х прошлого века все великие умы, увлечённые идеей программируемых компьютеров: создатели самой идеи компьютеров – Алан Тьюринг и Джон фон Нейман, автор «теории информации» Клод Шеннон, пророк «кибернетики» Норберт Винер… Рассуждали, но единого имени для этого феномена не было.

При этом математики (а на первых порах это в основном были, понятное дело, математики) – люди увлекающиеся, мыслящие сложными абстрактными конструктами. С человеческим языком у них, как правило, дела обстоят не очень.

Так что на роль названия для феномена, который мы знаем теперь как «искусственный интеллект», претендовали достаточно странные слова и словосочетания.

Например, понятие «автоматов» («исследование автоматов»). Фон Нейман, с которым Маккарти обсуждал свою идею, занимался «клеточными автоматами», а Шеннон, взявший Маккарти к себе на работу в Bell Labs, выпустил книгу об «автоматах», которую Маккарти даже пришлось редактировать.

То есть были все шансы у искусственного интеллекта называться, например, «умным автоматом», что, вероятно, многих его критиков примирило бы с действительностью мгновенно. Впрочем, в этом случае о другого рода «автоматах» шла бы речь – о математических, не об оборудовании с газировкой, но кого бы это смутило?

Было на повестке, конечно, и всякое «кибернетическое», а также «комплексная обработка информации», «машинный интеллект» и т. д.

Понятие «автоматы» Маккарти забраковал, потому что оно адресовало к математическим абстракциям (даже если это кому-то кажется забавным, это так).

Ничто а-ля кибернетическое Маккарти не нравилось, потому что основоположника кибернетики – Норберта Винера – он считал напыщенным занудой и думать не хотел о том, чтобы иметь с ним дело. В общем, как-то само собой нарисовалось слово «интеллект».

Но хотел ли Маккарти намекнуть нам на некое подобие мыслительной функции человека и этого своего «искусственного интеллекта»?

Как выясняется, нет. Впоследствии он не раз писал и говорил, что область, которую он обозначил «искусственным интеллектом», не имеет отношения к поведению человека – это просто такое слово-образ.

Но слово вылетело – не поймаешь: термин «искусственный интеллект» стал ассоциироваться с заменой человеческого разума машинным, о чём на самом деле речи-то и не шло.

Идея названия состояла не в прямой связи, не в замене и даже не в дополнении человеческого интеллекта искусственным (хотя уже тогда это и стало происходить), а в аналогии: у человека есть некая интеллектуальная функция принятия решений, и у машины есть нечто подобное – неживое, как и сама машина, искусственное.

В общем, математики, собравшиеся в 1956 году в рамках Дартмутского летнего исследовательского проекта, организованного Джоном Маккарти при финансовой поддержке Фонда Рокфеллера, подвоха не почувствовали, проголосовали – и название «искусственный интеллект» шагнуло в мир.

Показательно, кстати, что в программе этой конференции не было никаких докладов, которые были бы как-то связаны с поведением человека или его интеллектом.

Сейчас нет ни одного форума по искусственному интеллекту, где бы не говорили о биологическом интеллекте, механизмах мозга, обратной эмуляции коннектома и тому подобных вещах. Но для Маккарти подобные вещи выглядели бы глупо и совершенно неуместно на конференции по «искусственному интеллекту».

Когда он и его коллеги обсуждали «искусственный интеллект», они вовсе не воображали себе тех роботов из голливудских блокбастеров, к которым мы за это время уже так привыкли. Они говорили о чём-то своём… Но о чём именно?

Чтобы понять это, давайте посмотрим на ставшие уже классическими примеры искусственного интеллекта – да, слабого, но полностью отражающего существо феномена.

В 1998 году Ларри Пейдж, под руководством своего наставника Терри Винограда и в соавторстве с Сергеем Брином, опубликовал в IEEE Data Engineering Bulletin статью под названием «Что можно сделать с сетью в кармане?», где была сформулирована концепция будущей поисковой системы Google – по тем самым легендарным уже гиперссылкам.

Уже через несколько месяцев предприимчивые Пейдж с Брином ушли из Стэндфордской лаборатории и основали свою компанию, которая теперь обладает главным в мире интернет-поисковиком.

Но успех их проекта – это не какое-то единичное техническое решение двух удачливых стэнфордских магистрантов, а гигантский искусственный интеллект, изо дня в день осуществляющий сложнейшую работу по ранжированию и выдаче страниц, мониторингу сайтов и поведения конкретных пользователей, продаже рекламы и т. д., и т. п.

Количество искусственных интеллектов, созданных Google за два десятка лет, вообще-то говоря, колоссально.

Вот взять, например, Google Translate – это самообучающийся и постоянно совершенствующийся искусственный интеллект. Изначально ему было предложено соотнести десятки тысяч документов, которые за долгие годы были созданы на различных языках бесчисленными переводчиками Организации Объединённых Наций.

Это оказалось блестящим решением – где ещё отыщешь такое огромное количество текстов, которые с предельной точностью одновременно переведены на огромное количество национальных языков?

Искусственный интеллект Google подошёл к делу технически безукоризненно: он обнаружил в продублированных на разные языки текстах множество взаимосвязей, корреляций и соотношений и, можно сказать, буквально научился на этих языках говорить.

Теперь, когда вы предлагаете Google Translate перевести какой-то текст, он не просто вываливает на вас набор слов из бесчувственного словаря, а строит фразу, причём не только используя известные ему алгоритмы, но и параллельно совершенствуя их, самообучаясь.

«Получив предложение на английском языке и запрос перевода на немецкий, сервис сканирует все известные ему документы на английском и немецком, ищет точное совпадение и затем возвращает соответствующий текст на немецком языке. […] Компьютеры оценивают статистические закономерности в больших массивах ранее накопленного цифрового контента, создание которого потребовало больших затрат, но воспроизведение их не стоит почти ничего».

ЭРИК БРИНЬОЯФСОН, директор Центра цифрового бизнеса MIT,ЭНДРЮ МАКАФИ, социолог и экономист из MIT

Является ли такого рода «интеллектуальная» работа собственно интеллектом? И да, и нет. Если достаточно грубо обобщить то, что делает какой-нибудь Google Translate, то ситуация выглядит следующим образом:

• на его условный сенсор приходит некая информация, которую он должен сначала как-то распознать, идентифицировать, а потом отреагировать на неё;

• чтобы придумать адекватную реакцию на этот идентифицированный им как-то раздражитель, он должен сопоставить её с каким-то своим опытом – с тем, что он уже знает;

• он обращается к своей базе данных (своему «опыту») и находит некое соответствие, и производит реакцию – некое поведение, а проще говоря, предлагает перевод слова или фразы.

Если вы имеете хоть какое-то представление о том, как развивалась психотерапевтическая наука, а слова «бихевиоризм» и «когнитивно-поведенческая психотерапия» для вас не пустой звук, то вы уже понимаете, что мы имеем дело с классической моделью психики.

ПСИХОТЕРАПЕВТИЧЕСКИЕ РАЗВИЛКИ

Когда говорят о психотерапии, то первым делом вспоминают, конечно, классический психоанализ. Фигура Зигмунда Фрейда и правда была грандиозной, а думать о сексе, согласитесь, куда приятнее и привычнее, чем о чём-либо ещё. Но психоанализ ни в практическом, ни в концептуальном плане не выдержал испытания временем. Это красивая теория, но она ненаучна.

Наука начинается с нейрофизиологии – с наших соотечественников И. М. Сеченова, И. П. Павлова, А. А. Ухтомского, Л. С. Выготского, А. Р. Лурии, П. К. Анохина… Об открытиях этих великих учёных я уже много раз рассказывал в других своих книгах, а здесь нас интересуют лишь общие схемы – на них и остановимся.

Настоящему учёному, который занимается исследованием человеческого поведения, вполне очевидно, что он никак и ни при каких обстоятельствах не может достоверно знать, что происходит в голове у другого человека: нельзя прочитать его мысли, прочувствовать, что он чувствует, увидеть мир его глазами и т. д.

Да, можно представить, догадываться о чём-то, но это уже не наука, а кофейная гуща. Такую не-науку, например, пыталась в своё время запродать советскому правительству и госорганам Наталья Петровна Бехтерева – мол, электроды в голову встроим, ЭЭГ снимем и будем знать, что человек думает! Где сейчас то правительство и те органы – хорошо известно, а Наталья Петровна на старости лет ловко переключилась с электродов на мистику и эзотерику.

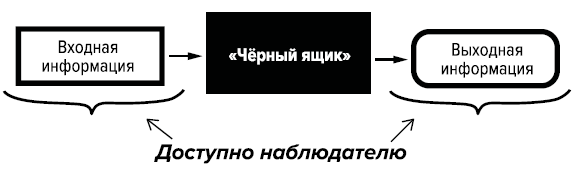

Для бихевиориста есть только то, что он может достоверно свидетельствовать: стимулы (входная информация) и реакции (выходная информация), воздействие и поведение. А вот то, что в центре – между стимулом и реакцией, – это уже, с научной точки зрения, terra incognita, по меткому замечанию Берреса Фредерика Скиннера, «чёрный ящик».

Короче говоря, вот первый и максимально объективный научный взгляд на наши с вами психические процессы:

Но время шло, наши знания о поведении живых существ разрастались. Нейрофизиологи формулировали новые теории, делали предположения и подтверждали их в экспериментах: например, эффект «динамической стереотипии» (И. П. Павлов), «принцип доминанты» (А. А. Ухтомский), феномен «акцептора результата действия» (П. К. Анохин) – всё это, конечно, лишь концепты, но рабочие и полезные.

С другой стороны, в конце 1960-х годов Скиннеру с его «ящиками» вызов бросили когнитивисты. Первым среди смельчаков был американский лингвист, автор порождающих грамматик и классификации формальных языков – Ноам Хомский. Именно он указал Скиннеру на следующее противоречие.

Согласно бихевиоральному взгляду на психику, у нас с вами должны формироваться жёсткие, устойчивые нервные связи между конкретными стимулами и зонами мозга, отвечающими за реакцию, но почему мы на одни и те же слова реагируем по-разному? Что позволяет нам строить бесконечное количество разных предложений, если всё в этом «ящике» так жёстко – условно-рефлекторно – детерминировано?

«Чёрный ящик» бихевиоризма с грохотом раскрылся (или, по крайней мере, дал трещину), что, наверное, само по себе и неплохо. Но кое-чего мы, конечно, не рассчитали: вскрыть – это полдела, вопрос: что мы там обнаружим? И обнаружим ли вообще хоть что-то определённое и доказуемое?

Да, в образовавшуюся у «чёрного ящика» щель тут же напихали всё, что только могло прийти психологам в голову: память, внимание, мышление, эмоции, желания, мотивы, убеждения, сознание, субъективный опыт, квалиа, потребности, бессознательное, привычки, чувства, язык, когниции, самость, переживания, комплексы, личность, речь, гештальты, подсознание, стереотипы, экзистенция, социальные роли, инграммы, внутренние конфликты, эго, самоактуализация, инсайт, Взрослый-Родитель-Ребёнок, стремления, инстинкты, «Система I» и «Система II», иррациональные установки, глубинные мотивы, автоматизмы, интеллект…

Более прозрачным от этого «чёрный ящик», конечно, не стал. Но зато теперь, если вы хотите узнать, что с вами будет делать психолог или психотерапевт на своей консультации, вам достаточно просто спросить у него, что он в вас «видит». Вы сразу поймёте, какими стимулами он будет на вас воздействовать, чтобы получить желаемую реакцию (поведение).

Если он «видит» в вас «патологические условные рефлексы», то готовьтесь к положительным и отрицательным подкреплениям – он бихевиорист старой школы.

Если он «видит» в вас «иррациональные убеждения», то вам предстоит их систематическое переосмысление – вы попали на приём к когнитивноповеденческому психотерапевту.

Если он «видит» в вас «незавершённые гештальты» – их будут расковыривать и завершать, и да – вами занимается гештальт-психотерапевт.

Если он «видит» в вас «сущность», то неизбежно примется её самоактуализировать, ища глубинные причины ваших «экзистенциальных страданий», – он гуманистический психолог.

Всё это я к тому, что концептуализировать содержимое «чёрного ящика» можно как угодно, но суть от этого не меняется – это лишь модели и концепты, попытка как-то формализовать и рационализировать наш опыт (в данном случае психологический, психотерапевтический).

Фокус состоит в том, что ни одно из приведённых мною понятий не имеет никакого внятного референта (означаемого) в действительной психике. То есть они все обозначают что-то, что никто в глаза не видел, что нельзя определить, зафиксировать или хотя бы просто однозначно толковать.

Попросите дипломированного психолога, потехи ради, чтобы он рассказал вам, что такое, например, память. А потом, когда он легко и просто с этой задачей справится, пусть он проведёт различие между оперативной памятью и работой сознания, или кратковременной памятью и вниманием, памятью на будущее и воображением или планированием, памятью на прошлое и условно-рефлекторным опытом…

И ведь за это всё научные степени дают – кандидатские присваивают, докторские, даже в академики, наверное, выбирают (тут, впрочем, я не уверен).

Всем этим я хочу сказать, что наблюдаемая нами разница между «интеллектами» человека и машины – лишь кажущаяся. Безусловно, она есть, эти «интеллекты» не идентичны. Но то, что мы считаем этой «разницей», ею точно не является, она в чём-то другом. И нам предстоит понять, в чём именно.

Но вернёмся пока к истории с названием «искусственный интеллект», которая со временем стала походить на трагикомический сериал.

Как я уже сказал, Джон Маккарти думал лишь о том, как с помощью компьютеров помочь человеку в решении задач, с которыми мы так или иначе сталкиваемся. Он был большим поклонником математической логики, применение которой искал в своей работе.

В общем, называя «искусственным интеллектом» искусственный интеллект, он и не предполагал, что кто-то решит, что речь идёт о создании существа, подобного человеку. Сам того не желая, он учинил большую языковую игру…

Будучи невероятным трудягой и успешным учёным, Маккарти основал в Стэнфорде Лабораторию искусственного интеллекта, которая на протяжении многих лет занималась самыми разными исследованиями в области робототехники, машинного зрения, распознавания речи и т. д.

Спустя полвека после той исторической сессии Дартмутского летнего исследовательского проекта, где на свет появилось словосочетание «искусственный интеллект», Джон Маккарти напишет:

«Проблема состоит в том, что пока мы не можем в целом определить, какие вычислительные процедуры мы хотим называть интеллектуальными. Мы понимаем некоторые механизмы интеллекта и не понимаем остальные. Поэтому под интеллектом в пределах этой науки понимается только вычислительная составляющая способности достигать целей в мире».

Но одновременно с этой фактической работой учёных языковая игра с «искусственным интеллектом», невольно затеянная Маккарти, получала, так сказать, своё параллельное развитие.

Для любых фундаментальных научных исследований, как вы понимаете, нужны средства. А где их взять? Да, обивать пороги толстосумов.

Впрочем, с 1958 года стараниями президента Эйзенхауэра, испугавшегося первого советского космического спутника, у американских учёных появился почти неиссякаемый источник финансирования в виде Управления перспективных исследовательских проектов Министерства обороны США (DARPA).

Проще говоря, чтобы получить баснословный грант на исследования, нужно было уговорить военных дать вам денег. Но как объяснить этим солдафонам, что исследование того стоит? Тут надо немножко приукрасить действительность…

Замечательный исследователь истории зарождения искусственного интеллекта Джон Маркофф приводит в своей книге «Homo roboticus» несколько историй о том, как Чарли Розен – один из главных лоббистов искусственного интеллекта в Пентагоне – разговаривал с потенциальными заказчиками исследований в области искусственного интеллекта.

Когда, например, генералы Пентагона спрашивали у Розена, сможет ли его робот носить пистолет, он не мешкая отвечал: «А сколько нужно? Думаю, он легко управится с двумя или тремя!»

И его тут же забрасывали следующими вопросами, которые уже сами по себе убеждали военных, что игра стоит свеч: «Вы хотите сказать, что ваша машина может быть часовым?», «Можно ли использовать её вместо солдата?» и т. д.

Теперь мы знаем, что всё это возможно: и военные беспилотники, и «часовые» всех видов и мастей, и антропоморфные солдаты с пистолетами, но тогда – в конце 1950-х годов, со стороны Розена это, конечно, была чистой воды авантюра.

С оговорками, очень аккуратно, он обещал Пентагону создать робота-человека. При этом, конечно, речь шла не об искусственном человеке, а о специальных компьютерных программах, которые смогут выполнять те или иные функции. Но в это, как оказалось, сложнее поверить, чем в явление существа из компьютерных плат и проводов.

И правда, представить себе того самого Терминатора – много ума не надо, а вот слушать про всё это машинное обучение, нейронные сети, символьные системы, базы данных, алгоритмы, рекуррентность, объектно-ориентированные языки, дедуктивные и индуктивные методики – это, конечно, невообразимая… скукота.

В общем, первым в «искусственный интеллект» поверил Пентагон, а уж после появления культовой «Космической одиссеи-2001» Стэнли Кубрика в 1968 году и вовсе сомнений ни у кого не осталось – учёные делают сверхмощное существо, которое нарушит законы робототехники Айзека Азимова и уничтожит человечество как вид. Ну, или, по крайней мере, как-нибудь его поработит.

Ирония состоит в том, что создавать человека на искусственном носителе не только очень сложно, затратно и, скорее всего, почти невозможно, но в том, что это абсолютно бессмысленно – он слишком плохо справляется с задачами, которые искусственный интеллект щёлкает как орехи.

«Мы спроектировали машины таким образом, чтобы они действовали подобно людям. […]

А поскольку они ведут себя так же, как мы, было бы разумно предположить, что они и думают похожим образом. Но реальность такова, что они вообще не думают в человеческом понимании этого слова; в действительности мы не знаем даже, почему они демонстрируют то поведение, которое мы наблюдаем. Вот в чём суть их непостижимости.

Возможно, с какого-то момента нам придётся беспокоиться по поводу всесильного искусственного интеллекта. Но сперва нам надо озаботиться тем, что машинам приходится отвечать за решения, для принятия которых у них недостаточно ума».

ДЖОН КЛЕЙНБЕРГ, Корнеллский университетСЕНДИЛ МУЛЛАЙНАТАН, Гарвардский университет