10. Искусственный разум и кремниевое сознание

Нет, я не хочу создать мощный мозг. Все, что мне нужно, — это посредственный мозг, как, скажем, у президента компании AT&T.Алан Тьюринг

В феврале 2011 г. произошло историческое событие.

Компьютер фирмы IBM по имени Watson сделал то, что многие критики считали невозможным: победил двух соперников-людей в телеигре Jeopardy! (В России аналог этой игры называется «Своя игра».) Миллионы зрителей, прильнув к экранам, с удивлением наблюдали за тем, как Watson методично уничтожал своих оппонентов на национальном телевидении; компьютер отвечал на вопросы, ставившие в тупик соперников, и в конце концов получил право требовать приз в миллион долларов.

IBM постаралась снять все ограничения и собрать машину поистине монументальной вычислительной мощности. Watson способен обрабатывать данные с ошеломляющей скоростью 500 Гб/с (что эквивалентно миллиону книг в секунду) и располагает 16 Тб оперативной памяти. Кроме того, в его памяти хранится 200 млн страниц всевозможных справочных материалов, к которым он имеет доступ, включая весь объем знаний Википедии. Таким образом, в прямом эфире Watson имел возможность анализировать всю эту гору информации.

Watson представляет собой всего лишь последнее поколение «экспертных систем» — компьютерных программ, использующих формальную логику для доступа к громадным объемам специализированной информации. (Подключаясь по телефону к автомату, который представляет вам меню для выбора опций, вы имеете дело с примитивной экспертной системой.) Разумеется, экспертные системы будут развиваться и дальше, делая нашу жизнь более удобной и эффективной.

Так, в настоящее время инженеры работают над созданием рободоктора, который будет появляться на экране наручных часов или на большом настенном экране и почти бесплатно давать медицинские советы с точностью 99 %. Вы расскажете ему о своих симптомах, а он проведет поиск по базам данных ведущих мировых медицинских центров и соберет последнюю научную информацию. Это позволит избежать лишних визитов к врачу и дорогостоящих ложных тревог; регулярные беседы с врачом уже не будут требовать никаких усилий.

Со временем у нас, возможно, появятся робоюристы, способные ответить на любой рутинный законоведческий вопрос, или робосекретари, которым не составит труда организовать для вас отпуск, путешествие или деловой обед. (Разумеется, для специализированной помощи и профессионального совета вам в любом случае потребуется живой юрист, врач или секретарь, но для ответов на повседневные вопросы подобных программ будет достаточно.)

Кроме того, ученые создали так называемые чат-боты, способные имитировать обычный разговор. Средний человек, как правило, знает десятки тысяч слов. Чтение газет требует знания около 2000 слов или более, но разговор ни о чем, как правило, ведется с использованием всего лишь нескольких сотен слов. Роботов можно запрограммировать на ведение беседы с таким ограниченным словарным запасом (если, конечно, разговор будет ограничен несколькими строго определенными темами).

Любимая страшилка СМИ — роботы идут

Вскоре после того, как Watson выиграл состязание, некоторые «эксперты» уже ломали руки, заранее оплакивая тот страшный день, когда машины возьмут над нами верх. Кен Дженнингс, один из игроков, уступивших первенство компьютеру, заметил в разговоре с представителем прессы: «Я, к примеру, приветствую наших новых компьютерных владык». «Эксперты» задавались вопросом: если Watson смог победить в очном состязании опытных и закаленных участников шоу, то какие шансы имеем мы, простые смертные, устоять перед машинами? Дженнингс наполовину в шутку сказал: «Брэд (второй участник шоу. — Авт.) и я стали первыми работниками индустрии знаний, которые лишились работы по милости нового поколения «думающих» машин».

Комментаторы, однако, забыли упомянуть, что человек не может подойти к компьютеру и поздравить его с победой. Невозможно похлопать его по спине или выпить с ним шампанского. Он не поймет, что это значит; более того, Watson вообще не подозревает, что выиграл. Если отбросить фантазии падких на сенсацию журналистов, получится, что Watson — это сложнейшая счетная машина, способная проводить вычислительные операции (или поиск данных) в миллиарды раз быстрее, чем человеческий мозг, у которой полностью отсутствует самосознание и здравый смысл.

С одной стороны, в области искусственного интеллекта достигнут поразительный прогресс, особенно если смотреть чисто по вычислительной мощности. Человек, живший в начале XX в., посмотрев на сегодняшние компьютерные вычисления, счел бы машины чудом. Но с другой стороны, если говорить о создании машин, способных думать самостоятельно (т. е. настоящих мыслящих автоматов, для которых не нужен ни кукловод, ни оператор с джойстиком или пультом дистанционного управления), то прогресс невелик. Роботы пока еще не имеют представления о том, что они роботы.

Поскольку вычислительные мощности компьютеров в соответствии с законом Мура последние 50 лет удваиваются каждые два года, кое-кто считает, что это лишь дело времени и что когда-нибудь машины обретут самосознание, способное соперничать с человеческим. Никто не знает, когда именно это произойдет, но человечество должно быть готово к тому моменту, когда машинное сознание покинет пределы лабораторий и выйдет в мир. От того, как мы поступим с машинным сознанием, будет зависеть, возможно, будущее рода человеческого.

Взлеты и падения искусственного интеллекта

Трудно предсказать будущее искусственного интеллекта, поскольку он пережил уже три цикла взлетов и падений. В самом начале, в 1950-е гг., казалось, что механические горничные и бармены вот-вот появятся. Создавались машины, способные играть в шашки и решать алгебраические задачи. Разрабатывались манипуляторы, которые могли распознавать и поднимать кирпичики. В Стэнфордском университете был построен робот по имени Shakey — компьютер на колесной тележке с камерой, — способный самостоятельно ездить по комнате, объезжая препятствия.

Очень скоро в научных журналах появились восторженные статьи, предрекающие появление роботов-компаньонов. Некоторые предсказания оказались даже чересчур консервативными. Так, в 1949 г. журнал Popular Mechanics объявил, что «в будущем компьютеры будут весить не более полутора тонн». Но другие были дико оптимистичны и заявляли, что день роботов близится. Shakey когда-нибудь станет механической горничной или дворецким; он будет пылесосить ковры и открывать двери. Такие фильмы, как «2001: Космическая одиссея», убеждали нас в том, что очень скоро роботы будут вести наши ракетные корабли к Юпитеру и болтать с астронавтами. В 1965 г. доктор Герберт Саймон, один из основателей теории искусственного интеллекта, уверенно заявил: «Через 20 лет машины смогут делать все то же, что делает человек». Двумя годами позже еще один отец-основатель искусственного интеллекта, доктор Марвин Мински, сказал, что «на протяжении жизни этого поколения… проблема создания искусственного разума будет в основном решена».

Но в 1970-е гг. весь этот безграничный оптимизм рухнул. Шашечные компьютеры умели только играть в шашки, и больше ничего. Механические руки могли поднимать кирпичики, и только. Это были цирковые лошадки, обученные одному трюку. У самых продвинутых роботов на пересечение комнаты уходили часы. В незнакомой обстановке Shakey легко терялся. И ученым не удалось ни на шаг приблизиться к пониманию природы сознания. В 1974 г. искусственный интеллект перенес тяжелый удар: правительства США и Британии значительно сократили финансирование исследований в этой области.

В 1980-е гг., по мере того как росли вычислительные мощности компьютеров, в области искусственного интеллекта возникла новая золотая лихорадка; подпитывалась она тем, что составители планов Пентагона надеялись создать роботов-солдат и выставить их на поле боя. В 1985 г. финансирование разработок в области искусственного интеллекта достигло миллиарда долларов в год, причем сотни миллионов долларов тратились на проекты вроде Smart Truck, где речь шла о создании умных автономных тележек, способных проникать в тыл противника, самостоятельно проводить разведку, выполнять задания (к примеру, выручать пленных), а затем возвращаться на свою территорию. К несчастью, единственное, что они научились хорошо делать, — это теряться. Откровенные неудачи подобных дорогостоящих проектов вызвали в 1990-е гг. еще одну волну охлаждения к искусственному интеллекту.

Пол Абрахамс, вспоминая годы учебы в МТИ, сказал: «Это было так, будто группа людей предложила построить башню до Луны. Каждый раз они с гордостью указывают, насколько выше стала их башня по сравнению с прошлым годом. Единственная проблема в том, что Луна-то не становится ближе».

Но компьютерные мощности продолжают неуклонно расти, и сегодня можно сказать, что начался ренессанс искусственного интеллекта: наблюдается медленное, но реальное движение вперед. В 1997 г. компьютер Deep Blue фирмы IBM выиграл в шахматы у чемпиона мира Гарри Каспарова. В 2005 г. роботизированный автомобиль из Стэнфорда взял приз DARPA Grand Challenge для машины без водителя. Впереди новые достижения.

Остается вопрос: будет ли третий раз счастливым?

Сегодня ученые понимают, что сильно недооценили проблему, потому что большая часть человеческого мышления проходит на подсознательном уровне. Сознательные мысли — лишь крохотная часть работы мозга.

Доктор Стив Пинкер говорит: «Я готов хорошо заплатить за робота, который убирал бы со стола посуду или выполнял простые поручения, но не могу этого сделать, потому что мелкие задачи, которые необходимо решить для создания такого робота, такие как распознавание образов, здравые рассуждения и управление руками и ногами, представляют собой нерешенные инженерные задачи».

Голливудские фильмы уверяют нас, что ужасные Терминаторы уже за углом, но задача создания искусственного разума намного сложнее, чем считалось ранее. Я однажды спросил доктора Мински, когда машины сравняются с нами по интеллекту, а может быть, и превзойдут нас. Он ответил, что уверен в том, что это обязательно произойдет, но предсказаний о датах больше не делает. Учитывая бурную историю искусственного интеллекта, это, наверное, самый разумный подход: мы можем описать его будущее, не называя конкретных дат.

Распознавание образов и здравый смысл

Перед разработчиками искусственного интеллекта стоит как минимум две фундаментальные проблемы: распознавание образов и здравый смысл.

Наши лучшие роботы с трудом распознают простые объекты, такие как чашка или мяч. Если вывести робота на незнакомую оживленную улицу, он быстро потеряет ориентацию и заблудится. Глаз робота лучше различает детали, чем глаз человека, но мозг робота не в состоянии понять, что он видит. Поэтому распознавание образов (по существу, — узнавание объектов) прогрессирует намного медленнее, чем ожидалось.

Входя в комнату, робот должен провести триллионы действий, разбивая видимые объекты на точки, линии, круги, квадраты и треугольники и пытаясь совместить их с одним из тысяч хранящихся в памяти изображений. Так, роботы видят стул как «винегрет» из точек и линий, но не могут с легкостью определить его сущность как стула. Даже если робот может успешно совместить объект с изображением из базы данных, достаточно будет повернуть стул (скажем, уронить его на пол) или изменить перспективу (посмотреть на стул под другим углом), чтобы поставить робота в тупик. Ну а мозг человека автоматически учитывает эту разницу и прочие вариации. Мозг подсознательно проводит триллионы операций, а нам кажется, что процесс не требует усилий.

А еще у роботов проблемы со здравым смыслом. Они не знают простейших фактов о физическом и биологическом мире. Не существует уравнения, которое могло бы подтвердить такие самоочевидные (для нас, людей) утверждения, как «сырая погода неприятна» или «мать всегда старше дочери». В переводе подобной информации на язык математической логики уже достигнут некоторый прогресс, но дело в том, что для изложения здравого смысла четырехлетнего ребенка потребовались бы сотни миллионов строк компьютерного кода. Как сказал однажды Вольтер, «обыкновенный здравый смысл не так уж обыкновенен».

К примеру, один из самых продвинутых роботов по имени ASIMO создан в Японии (где производится 30 % всех промышленных роботов мира) корпорацией Honda. Этот чудесный робот ростом с маленького мальчика умеет ходить, бегать, подниматься по лестнице, говорить на нескольких языках и танцевать (намного лучше меня, кстати говоря). Я несколько раз общался с ASIMO на телевидении и был приятно поражен его способностями.

Однако мне довелось лично встретиться с создателями ASIMO, и я задал им ключевой вопрос: насколько умен этот робот по сравнению, скажем, с животным? Они признались мне, что речь может идти разве что об интеллекте жука. Хождение и разговоры — это в основном фокусы для прессы. Проблема в том, что ASIMO представляет собой, по существу, большой магнитофон. У него очень скромный набор по-настоящему автономных функций, почти каждый звук и каждое движение приходится тщательно программировать заранее. Так, нам потребовалось около трех часов, чтобы записать короткий ролик о том, как я общаюсь с ASIMO, потому что каждый жест и каждое движение программировала целая команда помощников.

Если мы рассмотрим все это вместе с нашим определением человеческого сознания, то получится, что нынешние роботы застряли на очень примитивном уровне — они все еще пытаются разобраться в физическом и социальном мире и овладеть базовыми фактами. Как следствие, роботы еще не дошли до стадии, на которой смогут моделировать будущее. К примеру, если вы хотите попросить робота спланировать ограбление банка, вы при этом считаете, что он знает основные факты о банках (хотя бы то, где именно в банке хранятся деньги), знает, какого рода там стоит охранная система и как полиция и зеваки будут реагировать на ситуацию. Кое-что из этого можно запрограммировать, но существуют сотни нюансов, которые человеческий мозг естественным образом понимает, а роботы пока не понимают вовсе.

Роботы прекрасно справляются с моделированием будущего в одном-единственном случае: если речь идет об одной строго определенной области, такой как игра в шахматы, моделирование погоды или столкновения галактик и т. п. Поскольку правила шахмат и законы тяготения известны уже не одно столетие, успешное моделирование шахматной партии или Солнечной системы зависит только от вычислительной мощности и времени.

Делались попытки преодолеть этот уровень при помощи грубой силы. Так, разработана программа под названием CYC, целью которой — решение задач на здравый смысл. CYC включала миллионы строк компьютерного кода с полным набором информации о здравом смысле и знаний, необходимых для понимания окружающего мира. Особенных успехов авторам программы достичь не удалось. Хотя CYC может обрабатывать сотни тысяч фактов и миллионы утверждений, она не в состоянии воспроизвести уровень интеллекта четырехлетнего ребенка. К несчастью, после нескольких оптимистических пресс-релизов работы над проектом практически остановились. Многие программисты ушли из проекта, все сроки миновали, но проект по-прежнему жив и действует.

Является ли мозг компьютером?

Где же мы ошиблись? Последние 50 лет ученые, работающие над проблемой искусственного интеллекта, пытались моделировать мозг при помощи аналогии с цифровыми компьютерами. Но, может быть, это слишком сильное упрощение. Как сказал однажды Джозеф Кэмпбелл, «компьютеры похожи на ветхозаветных богов: куча правил и никакого милосердия». Если убрать из процессора Pentium хотя бы один транзистор, компьютер немедленно встанет. А человеческий мозг способен неплохо работать, даже если от него останется половина.

Дело в том, что мозг — это не цифровой компьютер, а сложнейшая нейронная сеть. В отличие от цифрового компьютера, архитектура которого постоянна и не меняется (вход, выход и процессор), нейронная сеть представляет собой набор нейронов, которые постоянно меняют конфигурацию и усиливаются после выполнения каждой новой задачи. У мозга нет ни программы, ни операционной системы, ни Windows, ни центрального процессора. Вместо этого его нейронные сети многократно запараллелены, и при выполнении единственного дела — усвоения информации — срабатывает одновременно 100 млрд нейронов.

В свете всего этого исследователи искусственного интеллекта начинают сомневаться в подходе «сверху вниз», которым они пользовались последние 50 лет (как пример такого подхода можно привести попытку записи всех правил здравого смысла на CD), и перепроверять его. Сегодня исследователи искусственного интеллекта пытаются еще раз внимательно рассмотреть противоположный подход — «снизу вверх». Этот подход означает попытку следовать за матерью-природой, создавшей разумных существ (нас) путем эволюции, начав с простых животных, таких как черви или рыбы, и создавая все более сложные и сложные организмы. Нейронные сети должны учиться самостоятельно, делая ошибки и натыкаясь на препятствия.

Доктор Родни Брукс, бывший директор знаменитой Лаборатории искусственного интеллекта МТИ и один из основателей компании iRobot, производящей те самые механические пылесосы, что ползают теперь по многим гостиным, предложил совершенно новый подход к искусственному интеллекту. Почему бы вместо того, чтобы разрабатывать больших неуклюжих роботов, не создавать маленьких, компактных, жукоподобных роботов, которые будут самостоятельно учиться ходить, как это и происходит в природе? Во время интервью он рассказал мне, что всегда восхищался поведением комаров, которые, имея крохотный мозг с очень небольшим количеством нейронов, способны маневрировать в воздухе лучше любого роботизированного самолета. Он построил серию замечательно простых роботов, которых любя называют «инсектоидами» и «баг-ботами»; в МТИ они носились всюду и умудрялись выписывать петли вокруг более традиционных роботов. Целью этого проекта было создание роботов, которые «жили» бы по законам матери-природы и обучались методом проб и ошибок. Иными словами, учились передвигаться, натыкаясь на все вокруг.

(На первый взгляд может показаться, что этот процесс требует сложной программы. Ирония, однако, заключается в том, что нейронные сети вообще не требуют никакого программирования. Единственное, что делает нейронная сеть, — это постоянно меняет структуру внутренних связей, повышая прочность некоторых из них всякий раз после принятия верного решения. Так что программирование здесь ни при чем; главное — изменение самой сети.)

Когда-то фантасты представляли, что на Марсе будут работать сложные гуманоидные роботы, которые ходят и говорят в точности как мы и благодаря хитрым программам обладают почти человеческим интеллектом. Все с точностью до наоборот. Сегодня по поверхности Марса колесят внуки этого подхода — такие, к примеру, как марсоход Curiosity. Они не запрограммированы на ходьбу и обладают интеллектом жука, но при этом неплохо себя чувствуют в марсианской обстановке. У багботов относительно мало готовых программ; вместо этого они «набивают шишки» и учатся на собственном опыте.

Есть ли у роботов сознание?

Может быть, самый простой способ разобраться, почему настоящих роботов-автоматов до сих пор не существует, состоит в том, чтобы измерить уровень их сознания. Как мы видели в главе 2, можно выделить четыре уровня сознания. Уровень 0 описывает термостаты и растения; в нем задействованы несколько обратных связей по горстке простых параметров, таких как температура или солнечное освещение. Первый уровень сознания описывает насекомых и рептилий, которые подвижны и имеют центральную нервную систему; в нем создается модель окружающего мира с учетом нового параметра, положения в пространстве. Далее идет сознание уровня II, создающее модель мира с учетом отношений с себе подобными; для этого требуются эмоции. Наконец, сознание уровня I описывает человека: он включает время и самосознание, моделирует развитие событий в будущем и определяет собственное место в этих моделях.

Можно воспользоваться такой теорией и определить уровень сознания сегодняшних роботов. Роботы первого поколения находились на нулевом уровне сознания, поскольку были статичны и не имели колес или конечностей для ходьбы. Сегодняшние роботы соответствуют уровню I, поскольку они мобильны, но внутри этого уровня они располагаются в самом нижнем эшелоне, поскольку ориентируются в реальном мире с громадными трудностями. Их сознание можно сравнить с сознанием червя или медленного насекомого. Чтобы получить полноценное сознание уровня I, ученым придется создать роботов, способных реалистично имитировать сознание насекомых и рептилий. Даже насекомые обладают способностями, которых нет у сегодняшних роботов: они умеют быстро прятаться, отыскивать в лесу партнера для спаривания, распознавать хищника и уходить от него, отыскивать пищу и убежище.

Как мы уже упоминали, можно численно оценить сознание на каждом уровне по количеству обратных связей. К примеру, роботы, обладающие зрением, могут иметь несколько обратных связей, поскольку их зрительные сенсоры могут регистрировать тени, контуры, кривые, геометрические формы в трехмерном пространстве. Точно так же роботы, снабженные слухом, нуждаются в датчиках частоты, силы звука, акцентов, пауз и т. п. Полное число обратных связей у них может доходить примерно до десяти (тогда как у насекомого, которое живет в дикой природе, находит партнеров, убежище и т. п., обратных связей может быть пятьдесят или даже больше). Таким образом, типичный робот обладает, скажем, сознанием уровня I: 10.

Чтобы подняться до уровня II, роботам придется научиться моделировать мир с учетом отношений с окружающими. Как мы уже упоминали, сознание уровня II в первом приближении оценивается произведением числа членов группы на количество эмоций и жестов, используемых ими для общения между собой. Таким образом, роботы имели бы сознание уровня II: 0. Но можно надеяться, что эмоциональные роботы, создаваемые сегодня в лабораториях, вскоре поднимут свой уровень.

Нынешние роботы рассматривают человека как набор пикселов, движущихся на экранах датчиков, но некоторые исследователи искусственного интеллекта уже начинают создавать роботов, способных распознавать эмоции по выражению лица и тону голоса. Это первый шаг к тому, чтобы роботы «поняли»: человек — не просто набор случайных пикселов, и он может находиться в различных эмоциональных состояниях.

В ближайшие несколько десятков лет роботы будут постепенно подниматься в пределах сознания уровня II: сначала они сравняются по интеллекту с мышью, крысой, кроликом, а затем с кошкой. Не исключено, что к концу века они догонят по интеллекту обезьян и начнут ставить перед собой собственные цели.

Как только у роботов появятся пригодный к практическому использованию здравый смысл и теория разума, они получат возможность проводить сложное моделирование будущего с собой в главной роли и таким образом перейдут на сознание уровня III. Они покинут мир настоящего и вступят в мир будущего. Это, разумеется, на много десятилетий отстоит от реальных возможностей любого сегодняшнего робота. Моделирование будущего означает, что вы хорошо понимаете законы природы и причинности, владеете здравым смыслом и, соответственно, можете предвидеть будущие события. Это означает также, что вы понимаете человеческие намерения и мотивы, а, следовательно, можете предсказать поведение людей в будущем.

Численная оценка сознания уровня III получается, как мы уже говорили, путем деления полного числа причинно-следственных связей, которые можно выделить при моделировании будущего в различных ситуациях, на среднюю величину контрольной группы. Компьютеры сегодня способны проводить ограниченное моделирование по нескольким параметрам (к примеру, они могут смоделировать столкновение двух галактик, обтекание летящего самолета потоком воздуха, поведение здания во время землетрясения), но совершенно не готовы моделировать будущее в сложных жизненных ситуациях, так что уровень их сознания можно оценить как III: 5.

Понятно, что потребуется не одно десятилетие серьезных усилий, прежде чем у нас появится робот, способный нормально функционировать в человеческом обществе.

Помехи в пути

Итак, когда же роботы смогут наконец-то догнать и перегнать человека по интеллекту? Конечно, никто этого не знает, но предсказаний много. Большинство из них основано на предположении, что в ближайшие десятилетия закон Мура будет продолжать действовать. Однако закон Мура — вовсе не закон; более того, он, по существу, нарушает фундаментальный закон природы и противоречит квантовой теории.

Закон Мура как таковой не может действовать вечно. Уже сегодня мы видим замедление развития. К концу этого или, может быть, следующего десятилетия процесс, возможно, полностью затормозится, и последствия этого, особенно для Кремниевой долины, могут оказаться весьма печальными.

Суть проблемы проста. В настоящий момент вы можете разместить сотни миллионов кремниевых транзисторов на кристалле размером с ноготь, но для плотности упаковки элементов существует конкретный предел. Сегодня самый тонкий слой кремния на микросхеме Pentium составляет примерно 20 атомов в толщину, к 2020 г. толщина такого слоя может уменьшиться до пяти атомов. Но тогда вступит в действие принцип неопределенности Гейзенберга: вы не сумеете определить в точности, где находится электрон, и он сможет потихоньку «просочиться», уйти с проводящего слоя (см. приложение, где мы обсуждаем квантовую теорию и принцип неопределенности подробнее), и в микросхеме произойдет короткое замыкание. К тому же такая микросхема будет выделять тепла достаточно много, чтобы поджарить яичницу. Утечки и тепло со временем непременно положат конец действию закона Мура. Необходима будет замена.

Если размещение транзисторов на плоской подложке подходит к пределу в смысле компьютерной мощности, то Intel ставит миллиарды долларов на то, что микросхемы вскоре захватят третье измерение и станут объемными. Время покажет, оправдаются ли их надежды (одна из серьезнейших проблем объемных микросхем состоит в том, что выделение тепла стремительно растет с толщиной чипа).

Microsoft рассматривает другие возможности, такие как увеличение площади микросхемы с параллельной обработкой данных. Один из вариантов — расположить чипы горизонтально в ряд. Затем нужно будет разбить решаемую проблему программным путем на части, решить каждую часть отдельно на небольшом чипе и в конце вновь собрать информацию. Однако это не так просто: возможности программного обеспечения растут куда медленнее, чем та экспонента, о которой мы привыкли говорить в связи с законом Мура.

Подобные меры могут продлить действие закона Мура на несколько лет. Но со временем все это неминуемо закончится: квантовая теория возьмет верх. Это означает, что физики уже экспериментируют с широким спектром альтернатив, призванных прийти на смену эре кремния; это могут оказаться квантовые или молекулярные, оптические или нанокомпьютеры, ДНК-компьютеры и т. п. Однако пока ни одна из этих технологий не доведена до реального воплощения.

«Зловещая долина»

Предположим на мгновение, что когда-нибудь человечество будет сосуществовать на планете с невероятно сложными роботами, основанными, возможно, на молекулярных, а не на кремниевых транзисторах. Хотим ли мы, чтобы роботы были похожи на нас? И насколько похожи? Япония — мировой лидер в создании роботов, похожих на симпатичных собачек и детей, но японские дизайнеры стараются не делать своих роботов слишком человекоподобными: людей это нервирует. Первым это явление, получившее название «зловещая долина», исследовал доктор Масахиро Мори в Японии в 1970 г. Суть его заключается в том, что у человека при виде робота, слишком похожего на человека, возникает чувство отторжения. (На самом деле такой эффект первым упомянул еще Дарвин в 1839 г. в своем «Путешествии на Бигле»; писал о нем и Фрейд в очерке «Жуткое».) С тех пор это явление тщательно исследовали не только специалисты по искусственному интеллекту, но и мультипликаторы, рекламщики и все, кто работал над продвижением какого-нибудь продукта, связанного с человекоподобными изображениями. К примеру, в рецензии на фильм «Полярный экспресс» журналист CNN заметил: «От героев-людей в фильме откровенно… ну, мурашки по коже бегают. Так что «Полярный экспресс» в лучшем случае смущает, а в худшем вызывает легкий ужас».

Если верить доктору Мори, чем сильнее робот похож на человека, тем более сильную эмпатию мы к нему испытываем, но только до определенного предела. Когда внешность робота реально приближается к человеческой, эмпатия резко снижается — отсюда и «зловещая долина». Если робот очень похож на нас, за исключением нескольких мелких деталей, которые представляются жуткими, он вызывает у человека чувство отторжения и страха. Если же робот полностью похож на человека и не отличим от вас или от меня, мы вновь проявляем положительные эмоции.

Из всего этого могут следовать вполне практические выводы. К примеру, должны ли роботы улыбаться? На первый взгляд представляется очевидным, что роботам следует улыбаться, приветствуя людей и демонстрируя им свое расположение. Улыбка — универсальный жест тепла и приязни. Но если улыбка робота будет слишком реалистичной, на людей она подействует, будто «мороз по коже». (Кстати говоря, маски для Хеллоуина часто изображают жутких вампиров с широкой ухмылкой на лице.) Так что улыбаться, наверное, должны только роботы, похожие на детей (т. е. с круглым лицом и большими глазами) или абсолютно неотличимые от человека, и больше никто. (Когда человек выдавливает из себя улыбку, он активирует лицевые мышцы при помощи команды от префронтальной коры. Но когда улыбка естественная, то нервами управляет лимбическая система и задействованы при этом немного другие мышцы. Человеческий мозг способен заметить тонкую разницу между тем и другим, и эта его особенность положительно сказалась на ходе эволюции.)

Этот эффект можно изучить и на снимках мозга. Скажем, можно поместить испытуемого в МРТ и показать ему видеозапись робота, который по виду неотличим от человека, но двигается немного иначе, чуть дергано и механически. Мозг, когда видит что-то, всегда пытается предсказать поведение объекта в будущем. Видя полностью человекоподобного робота, мозг предсказывает, что и двигаться тот будет как человек. Когда же робот начинает двигаться, как машина, возникает противоречие, которое вызывает у нас тревогу. В частности, активизируется теменная доля (особенно та ее часть, где двигательная кора граничит со зрительной). Считается, что в этой области теменной части присутствуют зеркальные нейроны. В этом случае зрительная кора принимает образ человекоподобного робота, а его движения предсказывает двигательная кора при помощи зеркальных нейронов. А орбитофронтальная кора, расположенная непосредственно за глазами, собирает все это воедино и объявляет: «Хм, что-то здесь не так».

Голливудские режиссеры прекрасно знают об этом эффекте. Расходуя миллионы долларов на фильм ужасов, они понимают, что самая страшная сцена — не та, где из кустов вылезает гигантский пузырь биомассы или чудовище Франкенштейна. Самая страшная сцена — та, где мы видим извращение обыденного. Вспомните фильм «Экзорцист». Во время какой сцены зрители испытывали сильнейший приступ тошноты и выбегали из зала или падали в обморок прямо на местах? Может быть, во время появления демона? Нет. Кинотеатры по всему миру взрывались дикими криками и громкими рыданиями в тот момент, когда Линда Блэр поворачивала голову задом наперед.

Этот эффект можно продемонстрировать на молодых обезьянах. При виде изображений Дракулы или Франкенштейна они смеются и рвут картинки. А вот изображение обезглавленной обезьяны вызывает у них вопли ужаса. Опять же самый сильный страх вызывает извращение обыденного. (В главе 2 мы упоминали о том, что пространственно-временная теория сознания объясняет природу юмора, поскольку мозг моделирует возможное развитие событий, а затем слышит коронную, самую главную и обязательно неожиданную фразу. Так же объясняется и природа ужасного. Мозг моделирует будущее обычного будничного события, а затем испытывает шок, когда обычное вдруг извращается.)

Так что роботы и дальше по виду будут напоминать детей, даже если догонят человека по интеллекту. И только когда роботы научатся вести себя вполне по-человечески, дизайнеры сделают их действительно похожими на людей.

Кремниевое сознание

Как мы уже видели, человеческое сознание представляет собой лоскутное одеяло различных способностей, развившихся в результате миллионов лет эволюции. Получив в свое распоряжение информацию об окружающем мире — физическом и социальном, — роботы, скорее всего, смогут создавать модели не хуже (а в некоторых отношениях даже лучше) наших, но кремниевое сознание, судя по всему, будет отличаться от нашего в двух ключевых областях: по эмоциям и целям.

Так сложилось, что исследователи искусственного интеллекта оставили проблему эмоций в стороне, считая ее вторичной. Их целью было создание робота, который был бы логичен и рационален, а не рассеян и импульсивен. Поэтому в научной фантастике 1950-х и 1960-х большинство роботов (и гуманоидов, таких как Спок из «Звездного пути») обладало совершенным логическим умом.

Мы уже убедились, что из-за «зловещей долины» роботам, чтобы «жить» рядом с человеком, придется выглядеть вполне определенным образом. Некоторые считают, что этого мало, и роботы должны также обладать эмоциями, чтобы мы могли дружить с ними, заботиться о них и продуктивно с ними взаимодействовать. Иными словами, роботам необходимо сознание уровня II. Чтобы достичь этого, им для начала придется научиться распознавать весь спектр человеческих эмоций. Анализируя тонкие движения лица — бровей, век, губ, щек и т. п., — робот сможет определить эмоциональное состояние человека. Дальше всего в разработке этой темы продвинулась, вероятно, медиалаборатория МТИ. Мне повезло побывать в этой лаборатории под Бостоном несколько раз, и каждый визит туда напоминал мне экскурсию по заводу игрушек для взрослых. Везде, куда ни посмотри, взгляд натыкался на футуристические высокотехнологичные штучки, придуманные для того, чтобы наша жизнь стала интереснее, радостнее и удобнее.

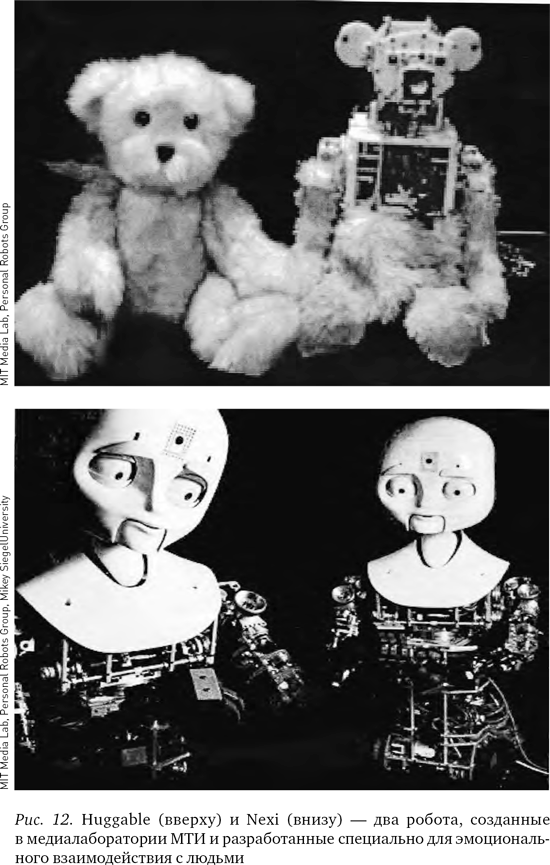

Оглядевшись вокруг, я увидел многое из той технографики, что позже попала в голливудские фильмы, такие как «Особое мнение» и «Искусственный разум». Бродя по этой игровой площадке будущего, я наткнулся на двух интереснейших роботов — Huggable и Nexi. Их создательница — доктор Синтия Бризель — объяснила мне, что у этих роботов особая цель. Huggable — это умный роботизированный плюшевый мишка, способный находить общий язык с детьми. Он может распознавать их эмоции; у него видеокамеры вместо глаз, динамик вместо рта и сенсоры в коже (так что он может «почувствовать», когда его щекочут, тыкают или обнимают). Когда-нибудь робот вроде этого, возможно, станет для ребенка наставником, нянькой, сиделкой или товарищем по играм.

Nexi же может находить общий язык со взрослыми. Внешне он немного похож на талисман компании Pillsbury. У него круглое, дружелюбное лицо с большими глазами, которыми он умеет двигать. Он уже испытан в доме престарелых и очень понравился там всем пожилым пациентам. Привыкнув к Nexi, пожилые люди полюбили разговаривать с ним и целовать его и очень скучали, когда Nexi увезли (рис. 12).

Доктор Бризель рассказала мне, что придумала Huggable и Nexi, потому что ни один из существовавших на тот момент роботов ее не устраивал: все они были похожи на банки с проводами, шестеренками и моторчиками. Чтобы сконструировать робота, способного взаимодействовать с людьми на эмоциональном уровне, ей пришлось разобраться в механизмах такого взаимодействия. Плюс к тому ей нужны были роботы, не привязанные к лабораторному столу, а способные выйти в реальный мир. Бывший директор медиалаборатории МТИ доктор Фрэнк Мосс говорит: «Именно поэтому Бризель в 2004 г. решила, что пора создавать новое поколение общественных роботов, способных жить где угодно: в семьях, школах, больницах, домах престарелых и т. п.»

В японском Университете Васэда ученые работают над созданием робота, у которого эмоции (страх гнев, удивление, радость, отвращение, грусть) выражаются движениями верхней части тела; он может слышать и видеть, чувствовать запахи и прикосновения. Он запрограммирован на достижение простых целей, таких как удовлетворение энергетического голода и стремление избежать опасных ситуаций. Цель ученых — интегрировать чувства и эмоции так, чтобы робот мог действовать в соответствии с ситуацией.

Чтобы не отставать, Европейская комиссия финансирует проект под названием Feelix Growing, цель которого — работа над искусственным интеллектом при сотрудничестве ученых Великобритании, Франции, Швейцарии, Греции и Дании.

Эмоциональные роботы

Познакомьтесь с Нао.

Когда счастлив, он протягивает вам навстречу руки и жаждет объятий. Когда ему грустно, он опускает голову и плечи и выглядит потерянным. Когда испуган, прячется в страхе, пока кто-нибудь не успокоит его, похлопав по голове.

Он ведет себя в точности как годовалый мальчик, вот только на деле он — робот. Ростом Нао около полуметра, а выглядит примерно так же, как выглядят роботы в магазине игрушек. На самом деле это один из самых продвинутых эмоциональных роботов на земле. Создали его ученые из Хартфордширского университета в Великобритании на деньги Европейского союза.

Создатели Нао запрограммировали в нем проявление эмоций, таких как радость, грусть, страх, радостное возбуждение и гордость. Если у других роботов эмоции передаются в лучшем случае через рудиментарные лицевые и вербальные жесты, то Нао прекрасно владеет языком тела, языком поз и жестов. Он даже умеет танцевать.

В отличие от других роботов, которые специализируются на овладении лишь одной какой-нибудь эмоцией, Нао овладел широким спектром самых разных эмоциональных реакций. Первым делом Нао фокусируется на лицах посетителей, узнает знакомых и вспоминает прошлые встречи с каждым из них. Затем начинает отслеживать все их движения. Так, он умеет отслеживать взгляд и определять, куда человек смотрит. На третьем этапе он начинает налаживать отношения с посетителями и учится реагировать на их жесты. К примеру, если вы улыбнетесь ему или похлопаете по голове, он поймет, что это хороший знак. В его мозгу действуют нейронные сети, поэтому он учится в процессе взаимодействия с людьми. На четвертом этапе Нао в ответ на взаимодействие проявляет эмоции. (Его эмоциональные реакции запрограммированы заранее и воспроизводятся по записи, но он сам решает, какую эмоцию выбрать, чтобы она соответствовала ситуации.) И наконец, чем больше Нао взаимодействует с конкретным человеком, тем лучше он понимает именно его настроения и тем сильнее связь между ними.

Нао не просто обладает собственной личностью, у него их несколько. Он учится в процессе взаимодействия с людьми, а каждый контакт уникален, поэтому со временем у Нао начинают проявляться несколько разных характеров. Один из них, к примеру, независимый и самостоятельный и не нуждается в особом руководстве со стороны человека. Другой — робкий и пугливый, пугается любого предмета в комнате и требует постоянного внимания к себе.

Руководит проектом Нао доктор Лола Каньямеро — специалист по информатике из Хартфордширского университета. Прежде чем начать работу над этим амбициозным проектом, она проанализировала поведение шимпанзе в стае. Ее целью было воспроизвести как можно точнее эмоциональное поведение годовалого шимпанзе.

Уже сегодня, по ее мнению, для подобных эмоциональных роботов найдется применение. Как и доктор Бризель, она хочет использовать их для облегчения психологического состояния маленьких детей, вынужденных находиться в больнице. Она говорит: «Мы хотим, чтобы они играли несколько ролей — роботы помогут детям разобраться в плане лечения, объяснят, что надо делать. Мы хотим помочь детям справиться с тревогой».

Еще одна возможность: такие роботы могут стать компаньонами пациентов домов престарелых. Нао мог бы стать ценным дополнением к штату любой больницы. А когда-нибудь такие роботы, как он, станут для детей товарищами по играм и членами семей.

«Трудно предсказывать будущее, но пройдет не так много времени, и ваш компьютер превратится в социального робота. Вы сможете разговаривать с ним, флиртовать, даже сердиться и кричать на него, а он будет понимать вас и ваши эмоции», — говорит доктор Терренс Сейновски из Института Солка возле Сан-Диего. Само по себе это несложно. Сложно откалибровать реакцию робота — ведь если хозяин сердит или недоволен, робот должен как-то учитывать это.

Эмоции: выделить важное

Но этого мало. Исследователи искусственного интеллекта начали понимать, что эмоции могут оказаться ключом к сознанию. Нейробиологи, такие как доктор Антонио Дамасио, обнаружили, что, когда связь между префронтальной долей (которая заведует рациональными мыслями) и эмоциональными центрами (т. е. лимбической системой) повреждена, пациенты не могут ничего оценивать. Они не в состоянии принять простейшее решение (что купить, на какое время назначить встречу, какого цвета ручку взять), потому что все вокруг, как им кажется, имеет одинаковую ценность. Так что эмоции — это не роскошь; они абсолютно необходимы, и без них роботу трудно определить, что важно, а что нет. Эмоции, которые прежде виделись где-то на периферии искусственного интеллекта, сегодня выходят на первый план.

Из огня пожара робот, возможно, сначала будет спасать не людей, а компьютерные файлы, поскольку программа говорит ему, что ценные документы заменить невозможно, а вот работникам всегда можно найти замену. Принципиально важно, чтобы программы роботов позволяли им отличать важное от неважного, и эмоции — кратчайший путь, которым пользуется мозг для оперативной оценки информации. Таким образом, роботам придется дать систему ценностей: что человеческая жизнь важнее материальных объектов, что детей в случае опасности следует спасать первыми, что дорогие вещи ценнее дешевых и т. п. Сами по себе роботы не появляются на свет с готовой системой ценностей, поэтому в каждого из них придется загрузить длиннющий список готовых оценок.

Однако проблема с эмоциями состоит в том, что иногда они бывают совершенно иррациональными, тогда как роботы устроены математически строго. Поэтому кремниевое сознание, возможно, будет ключевым образом отличаться от человеческого. Так, человек слабо контролирует свои эмоции: с одной стороны, потому, что они возникают стремительно, а с другой — потому, что возникают они в лимбической системе, а не в префронтальной коре мозга. Более того, наши эмоции, как правило, далеко не нейтральны. Многочисленные тесты показывают, что мы склонны переоценивать способности красивых людей. Вообще, симпатичные люди, как правило, выше поднимаются по социальной лестнице и получают лучшую работу, даже если они менее талантливы, чем другие. Как говорится, у красоты есть свои преимущества.

Вряд ли «кремниевое сознание» будет принимать во внимание тончайшие нюансы, которые учитываем при встрече мы, люди (к примеру, язык тела). Входя в комнату, молодой человек обычно уступает старшим, а простой клерк проявляет вежливость по отношению к старшим начальникам. Мы демонстрируем уважение и позой, и телодвижениями, и выбором слов, и жестами. Язык тела старше обычного языка, он буквально вшит в мозг. Роботам, если они собираются вращаться в одном обществе с людьми, придется освоить это искусство и выучить все детали поведения, воспринимаемые нами на подсознательном уровне.

Человеческое сознание отражает особенности нашего эволюционного прошлого, которого у роботов нет, так что у кремниевого сознания, может быть, не будет наших лакун и вывертов.

Набор эмоций

Поскольку эмоции в роботов придется записывать извне, не исключено, что производители предложат клиентам на выбор целое меню эмоций, тщательно подобранных исходя из того, являются ли они необходимыми, полезными или усиливают эмоциональную связь с владельцем.

По всей видимости, в роботов будут закладывать лишь по несколько человеческих эмоций, в зависимости от ситуации. Возможно, владельцы больше всего будут ценить верность. Конечно, каждому хочется иметь робота, который честно и без жалоб выполнял бы любые команды, понимал бы нужды хозяина и умел бы угадывать его желания. С другой стороны, последнее, что нужно владельцу, — это робот с собственным отношением к жизни, который будет огрызаться, критиковать всех вокруг или ныть. Критика, может быть, и нужна, но она должна быть конструктивной и тактичной. А если люди начнут давать роботу противоречивые команды, он должен уметь их игнорировать — все, кроме тех, что исходят от хозяина.

Эмпатия — еще одна эмоция, которую обязательно оценят владельцы роботов. Роботы, снабженные эмпатией, будут понимать проблемы других и приходить на помощь. Читая движения лицевых мускулов и прислушиваясь к тону голоса, такой робот сможет определить, расстроен ли человек, и предложить помощь, если это возможно.

Как ни странно, страх — тоже очень желательная эмоция. Эволюция не просто так снабдила нас чувством страха; страх помогает избегать опасностей. Роботам, хотя они и стальные, тоже нужно будет бояться некоторых потенциально опасных вещей, таких как падение с высоты или сильный огонь. Совершенно бесстрашный робот будет бесполезен, если при первом же случае загубит себя.

Но некоторые эмоции, возможно, придется уничтожить, запретить или по крайней мере строго регулировать. Речь идет прежде всего о гневе. Так как роботы в массе своей, скорее всего, будут обладать большой физической силой, разгневанный робот может создать проблемы и в доме, и на рабочем месте. Гнев может затмить в его сознании долг, и тогда горе имуществу. (Первоначальной эволюционной задачей гнева было продемонстрировать недовольство. Это, кстати говоря, можно сделать разумно, без грубости и злости.)

Еще одна эмоция, которую нужно будет исключить, — это желание командовать. Властный робот всегда будет создавать проблемы; кроме того, он может поставить под сомнение авторитет и желания владельца. (Этот пункт очень важен и в вопросе о том, возьмут ли когда-нибудь роботы верх над людьми.) Значит, робот всегда должен будет уступать желаниям хозяина, даже если это будет не лучшее решение.

Но сложнее всего, возможно, будет реализовать чувство юмора, способное, подобно клею, мгновенно объединить совершенно чужих людей. Простая шутка зачастую может разрядить или, наоборот, взорвать ситуацию. Базовый механизм юмора прост: в нем всегда присутствует главная, совершенно неожиданная фраза. Но тонкостей в этом деле хватает. Фактически мы часто оцениваем окружающих по тому, как они реагируют на определенные шутки. Если человек использует юмор как меру оценки других, то можно себе представить, насколько сложно создать робота, который мог бы определить, смешна шутка или нет. Президент Рональд Рейган, к примеру, был знаменит тем, что самые сложные вопросы умел парировать шуткой. Более того, он собрал огромную коллекцию шуток, колкостей и острот, потому что понимал важность и мощь юмора (некоторые эксперты считают, что он выиграл президентские дебаты у Уолтера Мондейла, когда на вопрос, не слишком ли он стар, чтобы быть президентом, ответил, что не будет ставить молодость своего оппонента ему в вину). С другой стороны, неуместный смех может вызвать катастрофические последствия (и иногда является признаком болезни психики). Робот должен знать разницу между смехом вместе с кем-то и смехом над кем-то. (Актеры прекрасно знают, что смех может быть очень разным. Смехом они способны выразить ужас, цинизм, радость, гнев, грусть и т. п.) Так что роботам, по крайней мере пока теория искусственного интеллекта развита недостаточно, лучше держаться подальше от юмора и смеха.

Программируя эмоции

До этого момента мы избегали вопроса о том, как именно можно запрограммировать эмоции для компьютера. Эмоции настолько сложны, что программировать их, вероятно, придется в несколько этапов.

Первое. Простейшая часть задачи — распознавание эмоции путем анализа выражения лица человека, положения его губ, бровей, тона голоса. Сегодняшние технологии распознавания лиц уже способны составить словарь эмоций, т. е. определить, что означают определенные выражения лица. Этот процесс, надо сказать, восходит еще к Чарльзу Дарвину, который потратил немало времени на составление каталога эмоций, общих для животных и человека.

Второе. Робот должен очень быстро отреагировать на эту эмоцию. Это тоже несложно. Если кто-то рядом смеется, робот улыбнется. Если кто-то сердится, робот уберется с его пути и постарается избежать конфликта. В программу робота будет зашита большая энциклопедия эмоций, поэтому он будет знать, как быстро отреагировать на любую из них.

Третье. Эта стадия может оказаться самой сложной, поскольку речь здесь идет о попытке определить внутреннюю мотивацию, лежащую за первоначальной эмоцией. Это сложно, поскольку одна и та же эмоция может возникнуть в очень разных ситуациях. Смех может означать, что человек счастлив, что он услышал смешную шутку или увидел, как кто-то упал в лужу. Смех может означать и то, что человек нервничает, тревожится или хочет кого-то оскорбить. Точно так же, если человек кричит, это может означать чрезвычайную ситуацию, а может — неожиданную радость или удивление. Определять причину эмоции — искусство, в котором даже люди испытывают трудности. Чтобы сделать это, роботу придется перебрать все возможные причины данной эмоции и попытаться определить самую вероятную из них. Это означает найти причину, которая наилучшим образом соответствовала бы всем имеющимся данным.

И четвертое. Определив причину эмоции, робот должен будет соответствующим образом на нее отреагировать. Это тоже непросто, потому что в любой ситуации, как правило, есть несколько вариантов реакции, а неверная реакция может серьезно ухудшить дело. В программе робота, конечно, должны присутствовать все варианты ответа на ту или иную эмоцию, и робот должен будет определить, какой из них лучше всего подходит для конкретной ситуации. А это значит, что он должен будет моделировать будущее.

Будут ли роботы лгать?

Обычно мы представляем себе роботов холодными и рациональными аналитиками, всегда говорящими правду. Но если роботы будут интегрированы в общество людей, им, вероятно, придется научиться лгать или по крайней мере тактично воздерживаться от комментариев.

Сами мы практически каждый день сталкиваемся с ситуациями, когда приходится говорить безобидную ложь. Если человек спрашивает, как он выглядит, мы зачастую не отваживаемся сказать ему правду. Безобидная ложь — это смазка, благодаря которой крутятся шестеренки общества. Если бы вам вдруг пришлось говорить только чистую правду, причем всю (как делал это герой Джима Керри в фильме «Лжец, лжец»), дело, скорее всего, кончилось бы полным хаосом и людскими страданиями. Окружающие обижались бы, когда вы искренне говорили бы им, как они на самом деле сегодня выглядят или что вы на самом деле чувствуете по отношению к ним. Начальник поспешил бы вас уволить. Возлюбленная бы вас бросила. Друзья отвернулись бы от вас, а посторонние норовили бы побить. Некоторые мысли лучше держать при себе.

Точно так же и роботам, возможно, придется научиться лгать или скрывать правду, иначе дело кончится тем, что они начнут оскорблять людей, а владельцы начнут отказываться от своих роботов. Правда, сказанная роботом на какой-нибудь вечеринке, может вызвать скандал и плохо отразиться на его хозяине. Так что роботам, если им будут задавать вопросы, придется освоить искусство дипломатии и такта и научиться уходить от ответа. Они должны будут научиться отвечать уклончиво, менять тему, ограничиваться банальностями, отвечать вопросом на вопрос или просто врать (кстати, сегодняшние интернет-боты с каждым днем все лучше справляются с этой задачей). Это означает, что в робота будет заранее зашит целый список возможных уклончивых ответов, и ему останется только выбрать тот из них, который вызовет наименьшее число осложнений.

Одной из немногих ситуаций, в которых робот обязан будет сказать полную правду, будет прямой вопрос хозяина; понятно, что, задавая такой вопрос, хозяин должен понимать, что ответ, каким бы неприятным ни оказался, будет абсолютно честным. Возможно, еще одной такой ситуацией будет полицейское расследование, где необходима абсолютная правда. В остальных случаях роботы смогут свободно лгать или утаивать часть правды, чтобы колеса общественной жизни не переставали крутиться.

Иными словами, роботам придется социализироваться, как подросткам.

Чувствуют ли роботы боль?

Скорее всего, роботам будут доставаться в первую очередь задачи монотонные, грязные и опасные. Им ничто не мешает делать одно и то же действие или одну и ту же работу до бесконечности, потому что мы не станем программировать их ни на скуку, ни на отвращение. Реальная проблема появится, когда роботы столкнутся с опасными заданиями, и в этот момент нам, возможно, придется запрограммировать их на ощущение боли.

Боль появилась в процессе эволюции потому, что это ощущение помогает выжить в опасной обстановке. Существует генетический дефект, при котором ребенок рождается неспособным ощущать боль. Называется это врожденной аналгезией. На первый взгляд такое свойство может показаться благословением (ведь эти дети не плачут, когда поранятся), но на деле это скорее проклятие. Дети с таким нарушением постоянно находятся в серьезной опасности: они нередко откусывают себе кусочек языка, могут сильно обжечься или порезаться, что часто ведет к ампутации пальцев. Боль предупреждает нас об опасности и говорит, когда нужно убрать руку от горячей плиты или перестать бегать на подвернувшейся ноге.

В какой-то момент роботов обязательно нужно будет запрограммировать на чувство боли, иначе они не смогут понять, как избежать рискованных ситуаций. Первым болезненным ощущением для них должен стать голод (т. е. чувство нехватки электроэнергии). По мере разрядки батарей робот должен будет чувствовать все более отчаянную и настоятельную нужду в электричестве, понимая, что скоро его схемы перестанут действовать и «жизнь» остановится. Чем ближе этот неприятный момент, тем тревожнее будет роботу.

Кроме того, каким бы сильным ни был робот, он может случайно поднять слишком тяжелый предмет, отчего у него могут сломаться конечности. Или он может перегреться, работая с расплавленным металлом на сталелитейном заводе или входя в горящий дом, чтобы помочь пожарным. Датчики температуры и напряжения предупредят робота о том, что параметры окружающей среды вышли за пределы его возможностей.

Но если добавить боль в меню эмоций робота, это сразу же поставит перед нами серьезные этические проблемы. Многие сегодня считают, что не следует причинять животным ненужные страдания, а завтра наверняка появятся люди, которые перенесут это отношение и на роботов, открыв тем самым двери проблеме прав роботов. Не исключено, что нам придется принимать законы, ограничивающие опасности, которым можно будет подвергать роботов. Люди не будут протестовать, если роботу выпадет скучная или грязная работа, но боль при выполнении опасных заданий — другое дело; не исключено, что найдутся люди, которые станут лоббировать принятие законов о защите роботов. Может возникнуть даже юридический конфликт, в ходе которого владельцы и производители роботов будут выступать за повышение допустимого уровня страданий для роботов, а специалисты по этике — за его снижение.

В свою очередь, это может инициировать новые этические дебаты на тему других прав роботов. Могут ли роботы владеть имуществом? Что произойдет, если робот случайно нанесет человеку вред? Можно ли подать на робота в суд или наказать его? Кто отвечает за робота в суде? Может ли робот владеть другим роботом? Это обсуждение повлечет за собой еще один спорный вопрос: нужно ли снабжать роботов этическим чувством?

Этичные роботы

Поначалу сама мысль об этичных роботах кажется пустой тратой времени и усилий. Однако вопрос становится насущным, если подумать о том, что роботы будут принимать решения по вопросам жизни и смерти. Они будут физически сильны и способны спасти жизнь человека в критической ситуации, поэтому им неизбежно придется принимать мгновенные решения о том, кого следует спасать первым.

Представим, что происходит землетрясение и в стремительно рушащемся здании заперта группа детей. Как должен робот распределить свою энергию? Должен ли он спасти как можно больше детей? Или ему следует спасать самых маленьких? Или самых беззащитных? Если обломки здания окажутся слишком крупными, робот, пытаясь их разобрать, может повредить свои электронные схемы. Так что роботу придется решать и еще один этический вопрос: как взвесить на одних весах число спасенных детей и степень повреждения его собственной электроники?

Без надлежащей программы робот может просто остановиться, ожидая, когда человек за него примет решение, теряя при этом драгоценное время. Так что кому-то придется заранее заложить в программу робота все необходимые данные и критерии, чтобы в нужный момент робот автоматически «принял» верное решение.

Решение этических проблем придется записывать в компьютерную программу заранее, еще при создании робота, поскольку не существует математических законов, которые позволили бы оценить спасение группы детей. В программе робота должен присутствовать длинный список самых разных вещей, ранжированных по важности. Создание такого списка — сложная и очень кропотливая работа. Даже у человека иногда на усвоение подобных этических уроков уходит целая жизнь, а робот, чтобы безопасно войти в общество, должен усвоить их практически одномоментно, еще до выхода с завода.

Только человек способен справиться с этическими проблемами, да и нас они иногда ставят в тупик. Возникает вопрос: кто будет принимать решения? Кто решит, в каком порядке робот должен спасать людей?

Вопрос о том, как в конечном итоге станут приниматься подобные решения, будет, по всей видимости, разрешен при помощи одновременно закона и рынка. Нам придется принять законы, чтобы по крайней мере вопрос о том, в каком порядке по важности следует спасать людей в критической ситуации, решался законодательно. Кроме того, возникнут тысячи более тонких этических вопросов. Их, вероятно, придется решать посредством рынка и здравого смысла.

Если вы работаете в охранной фирме, обеспечивающей безопасность важных персон, то вам придется объяснить роботу, в каком именно точном порядке ему следует спасать людей в различных ситуациях; при этом вы, вероятно, будете отталкиваться от необходимости, с одной стороны, выполнить контракт, а с другой — удержаться при этом в рамках бюджета.

Что произойдет, если преступник купит робота и захочет, чтобы тот совершил преступление? Возникает вопрос: должен ли робот иметь возможность не подчиниться хозяину, если тот попросит его нарушить закон? Из предыдущего примера мы видели, что роботы должны быть запрограммированы на понимание закона и принятие этических решений. Так что если робот решит, что его просят нарушить закон, то ему должно быть позволено не подчиниться хозяину.

Возникает также этическая дилемма в связи с роботами, отражающими взгляды своих хозяев, которые могут сильно различаться по моральным и социальным нормам. Сегодняшние «культурные войны» в обществе только усилятся, если появятся роботы, разделяющие взгляды и верования хозяев. В определенном смысле этот конфликт неизбежен. Роботы — механическое продолжение мыслей и желаний своих создателей, и когда они станут достаточно сложными, чтобы принимать моральные решения, они будут это делать.

Общество может столкнуться с неочевидными сегодня и неожиданными проблемами, когда роботы начнут демонстрировать поведение, бросающее вызов нашим ценностям и целям. Роботы, принадлежащие юнцам, расходящимся с шумного рок-концерта, могут вступить в конфликт с роботами, принадлежащими пожилым жителям тихого района. Первые, может быть, будут запрограммированы на громкое воспроизведение модной музыки, а вторые — на сохранение тишины. Роботы, принадлежащие набожным людям, могут не сойтись во мнениях с роботами, принадлежащими атеистам. Роботы разных национальностей и культур могут быть сконструированы так, чтобы отражать соответствующие культурные стереотипы, и это понравится далеко не всем (в том числе и людям, не говоря уже о роботах.)

Итак, как нужно программировать роботов, чтобы избежать подобных конфликтов?

Это невозможно. Попросту говоря, роботы неизбежно будут отражать предпочтения и предрассудки своих создателей. В конце концов культурные и этические противоречия между роботами придется разрешать в судах. Никакие законы природы или науки не решат за нас моральные вопросы, так что в итоге для разрешения подобных социальных конфликтов придется писать соответствующие законы. Роботы не смогут решить моральные дилеммы, созданные людьми. Более того, появление роботов может их обострить.

Но если роботы смогут принимать этические и юридические решения, то в состоянии ли они чувствовать и понимать чувства других? Если роботу удастся кого-нибудь спасти, обрадуется ли он этому? Или сможет ли робот хотя бы осознать, что такое красный цвет? Холодный анализ ситуации и решение о том, кого нужно спасать, — это одно, а понимание и сочувствие — совсем другое. Так могут ли роботы чувствовать?

Понимание или чувство?

На протяжении столетий выдвигалось множество теорий о том, может ли машина думать и чувствовать. Философия, которой придерживаюсь лично я, называется «конструктивизм» и состоит в том, что вместо бесконечного обсуждения этого вопроса (а оно бессмысленно) нам следует направить свою энергию на создание реального автомата и посмотреть, как далеко нам удастся зайти. В противном случае мы увязнем в бесконечных философских дебатах, разрешить которые окончательно невозможно. Преимущества науки в том, что, когда все сказано и сделано, можно провести эксперимент и найти решение проблемы.

Таким образом, чтобы понять, смогут ли роботы думать, следует, вероятно, сделать робота и посмотреть, что получится. Некоторые исследователи, однако, заранее уверены, что машины никогда не научатся думать, как люди. Самый сильный их аргумент заключается в том, что, хотя робот способен манипулировать фактами быстрее, чем человек, он не «понимает», что делает. Он может работать с ощущениями (такими как цвет или звук) лучше человека, но не может по-настоящему «чувствовать» или «воспринимать» суть этих ощущений.

Так, философ Дэвид Чалмерс разделил проблемы искусственного интеллекта на две категории — проблемы простые и сложные. Проблемы простые — это создание машин, способных имитировать все больше человеческих способностей, таких как игра в шахматы, сложение чисел, распознавание определенных закономерностей и т. п. Проблемы сложные включают, в частности, создание машин, способных понимать чувства и субъективные ощущения, так называемые «квалиа».

Точно так, как невозможно объяснить, что такое красный цвет, слепому, так и робот никогда не сможет испытать субъективное ощущение красного цвета, говорят сторонники такой точки зрения. Даже если компьютер и сможет, наверное, быстро перевести китайские слова на английский, он никогда не сможет понять то, что переводит. В этой картине мира роботы напоминают улучшенные магнитофоны или счетные машины, способные воспроизводить информацию и оперировать ею с невероятной точностью, но без всякого понимания.

Эти аргументы следует принимать всерьез, но существует и другая точка зрения на вопрос квалиа и субъективного опыта. В будущем машины, скорее всего, научатся воспринимать такие вещи, как красный цвет, много лучше любого человека. Робот сможет описать физические свойства красного и даже поэтически использовать его в образной фразе. Но «почувствует» ли робот красный цвет? Вопрос лишается смысла, поскольку слово «чувствовать» точно не определено. В какой-то момент, когда сделанное роботом описание красного цвета окажется лучше сделанного человеком, робот сможет с полным правом спросить: а понимают ли люди по-настоящему красный цвет? Может быть, они не в состоянии понять его со всеми нюансами и столь же тонко, как робот.

Как сказал однажды бихевиорист Б. Ф. Скиннер: «Настоящая проблема не в том, думают ли машины, а в том, думают ли люди».

К тому же это только вопрос времени, когда роботы научатся определять китайские слова и использовать их в контексте намного лучше любого человека. В этот момент будет уже неважно, «понимает» ли робот китайский язык. Для практических целей компьютер будет владеть китайским лучше человека. Иными словами, слово «понимать» тоже точно не определено.

Однажды, когда роботы превзойдут нас по способности манипулировать словами и ощущениями, вопрос о том, «понимают» ли они их и «чувствуют» ли, лишится смысла. Это будет уже неважно.

Математик Джон фон Нейман сказал: «В математике не нужно понимать. Нужно просто привыкнуть».

Так что проблема не в «железе», а в природе человеческого языка, в котором слова, не определенные точно, для разных людей означают разное. Великого физика Нильса Бора однажды спросили, как можно понять глубокие парадоксы квантовой теории. Ответ, сказал Бор, заключается в том, как вы определите слово «понять».

Философ Дэниел Деннетт из Университета Тафтса написал: «Объективный тест, который позволил бы отличить умного робота от сознательного человека, невозможен. Так что у вас есть выбор: либо держаться за сложные проблемы, либо покачать головой и забыть о них. Просто перестать о них думать».

Иными словами, сложных проблем нет.

Для конструктивистской философии смысл не в том, чтобы спорить, может ли машина «почувствовать» красный цвет, а в том, чтобы сконструировать такую машину. В этой системе существует континуум уровней, описывающих слова «понимать» и «чувствовать» (это означает, что может оказаться возможной даже численная оценка степени понимания или ощущения). На одном конце шкалы мы имеем неуклюжих сегодняшних роботов, способных манипулировать в лучшем случае несколькими символами. На другом конце — человек, который гордится тем, что ощущает квалиа. Но время идет, и когда-нибудь роботы научатся лучше нас описывать ощущения на любом уровне. Вот тогда-то и станет ясно со всей очевидностью, что́ роботы понимают.

Именно такая философия стоит за знаменитым тестом Тьюринга. Алан Тьюринг предсказал, что однажды будет создана машина, способная ответить на любой вопрос так, чтобы по ответам ее невозможно было отличить от человека. Тьюринг говорил: «Компьютер тогда будет заслуживать наименования разумного, когда сможет обмануть человека и заставить его поверить, что он тоже человек».

Физик и нобелевский лауреат Фрэнсис Крик сказал об этом лучше всех. Последние сто лет, отметил он, биологи горячо спорили над вопросом «Что есть жизнь?». Теперь, когда мы многое узнали о ДНК, ученые понимают, что вопрос задан недостаточно точно. Сегодня вопрос «Что есть жизнь?» попросту ушел в тень. То же может со временем произойти с ощущением и пониманием.

Самосознание роботов

Какие шаги необходимо предпринять, прежде чем компьютеры, такие как Watson, осознают себя? Для ответа на этот вопрос нам придется вернуться к нашему определению самосознания как способности ввести себя в модель окружающего мира, а затем смоделировать будущее этого мира для достижения некой цели. Для первого шага — создания модели — требуется очень высокий уровень здравого смысла, позволяющий предвидеть различные варианты событий. Затем робот должен поместить себя внутрь этой модели, для чего требуется понимание различных вариантов действий, которые могут при этом потребоваться.

В Университете Мэйдзи (Япония) ученые уже сделали первые шаги к созданию робота с самосознанием. Это, конечно, программа-максимум, но ученые считают, что смогут ее выполнить путем создания роботов с теорией разума. Начали они с двух роботов. Первый из них был запрограммирован на выполнение определенных движений. Второй — на наблюдение за первым роботом и копирование его действий. Исследователям удалось сконструировать робота, который мог имитировать поведение другого робота, просто наблюдая за ним. Впервые в истории робот был создан специально для того, чтобы каким-то образом осознавать себя. Второй робот владеет теорией разума, т. е. он способен наблюдать за другим роботом и копировать его действия.

В 2012 г. учеными Йельского университета был сделан следующий шаг: они создали робота, который прошел зеркальный тест. Вообще, когда животных ставят перед зеркалом, они, как правило, думают, что видят в зеркале другое животное. Как известно, очень немногие животные способны пройти зеркальный тест, т. е. осознать, что видят в зеркале отражение самого себя. Ученые из Йеля построили робота по имени Нико, который внешне напоминает нескладный скелет из гнутой проволоки с механическими руками и выпученными глазами на макушке. Оказавшись перед зеркалом, Нико смог не только узнать в нем себя, но и определить положение предметов в комнате, глядя на их отражения. Мы делаем примерно то же, когда смотрим в зеркало заднего вида и определяем положение объектов позади нас.

Программист Нико Джастин Харт говорит: «Насколько нам известно, это первая роботизированная система, которая пытается использовать зеркало таким образом, что представляет собой существенный шаг к цельной архитектуре, которая позволяет роботам многое узнавать о своих телах и внешности путем самонаблюдения; кроме того, это важная способность, необходимая для успешного прохождения зеркального теста».

Роботы из Университета Мэйдзи и Йельского университета представляют собой новейшие достижения в плане создания сознающих себя роботов, поэтому несложно понять, что ученым предстоит еще многое сделать, прежде чем появятся роботы с самосознанием, которое было бы хоть сколько-то сравнимо с человеческим.

Это всего лишь первые шаги, поскольку наше определение самосознания требует, чтобы робот использовал эту информацию для моделирования будущего, а это выходит далеко за пределы возможностей Нико или какого бы то ни было другого робота.

Перед нами встает важный вопрос: как может компьютер полностью осознать себя? В научной фантастике часто встречается ситуация, в которой Интернет как глобальная сеть вдруг осознает себя, как Терминатор в одноименном фильме. Интернет сегодня связан со всей инфраструктурой современного общества (с канализацией, линиями электропередач, телекоммуникационными системами, оружием и т. д.), поэтому в случае обретения самосознания ему было бы несложно перехватить управление обществом. Мы в подобной ситуации оказались бы беспомощны. Ученые пишут, что может произойти в результате системного эффекта (т. е. если собрать воедино достаточно большое число компьютеров, неожиданный фазовый переход на более высокий уровень может произойти даже без дополнительного воздействия извне).

Однако сказать так означает сказать одновременно и слишком много, и слишком мало, поскольку все важные промежуточные шаги остаются за кадром. По существу, это то же самое, что сказать, будто бы при достаточном числе дорог вся шоссейная система в целом может вдруг осознать себя.

Но мы уже дали определения сознания и самосознания, поэтому сможем дать список шагов, посредством которых Интернет может обрести самосознание.

Во-первых, разумный Интернет должен будет постоянно моделировать свое место в окружающем мире. В принципе, такую информацию можно запрограммировать и ввести в Интернет извне. Для этого необходимо описать окружающий мир (т. е. землю, ее города и компьютеры); следует отметить, что информацию обо всем этом можно найти в том же Интернете.

Во-вторых, Интернет должен был бы поместить себя в созданную модель мира. Такую информацию тоже несложно получить. При этом нужно было бы включить в нее все характеристики Интернета (число компьютеров, узлов, линий связи и т. п.) и его отношений с внешним миром.

Но третий шаг намного сложнее остальных. Необходимо постоянно моделировать свое развитие в будущем в соответствии с поставленной целью. Здесь-то мы и натыкаемся на стену. Интернет не способен моделировать будущее, и у него нет целей. Даже в научном мире моделирование будущего обычно проводится лишь по нескольким параметрам (к примеру, моделирование столкновения двух черных дыр). Моделирование мира, включающего в себя Интернет, выходит за рамки сегодняшних возможностей программирования. Для этого необходимо было бы привлечь все законы здравого смысла, все законы физики, химии и биологии, а также данные о поведении человека и человеческого общества.

Плюс ко всему разумный Интернет должен был бы иметь цель. Сегодня это всего лишь пассивная сеть дорог без всякого выделенного направления и задачи. Конечно, в принципе Интернету можно придать цель. Но давайте рассмотрим следующую проблему: можно ли создать Интернет, целью которого было бы самосохранение?

Вообще-то это простейшая возможная цель, но никто не знает, как запрограммировать даже такую простую задачу. Такая программа, к примеру, должна была бы пресекать любую попытку отключить Интернет путем вынимания вилки из розетки. В настоящее время Интернет совершенно не способен распознать угрозу своему существованию, не говоря уже о том, чтобы спланировать действия по предотвращению беды. (Так, Интернет, способный распознавать угрозу своему существованию, должен был бы иметь возможность заранее узнавать о попытках отключить питание, разорвать линии связи, уничтожить серверы, разрушить оптико-волоконные и спутниковые каналы связи и т. п. Далее, у Интернета, способного защитить себя от подобных атак, должна быть возможность принять контрмеры при возникновении подобной угрозы; затем его следовало бы промоделировать в будущее. Ни один компьютер на земле сегодня не способен даже на малую долю перечисленных действий.)

Иными словами, не исключено, что когда-нибудь у нас появится возможность создавать сознающих себя роботов и даже сознающий себя Интернет, но произойдет это еще очень не скоро, возможно, в конце века.

Но предположим на мгновение, что день этот наступил и сознающие себя роботы уже среди нас. Если цели такого робота совместимы с нашими собственными целями, то этот тип искусственного интеллекта не создаст для нас никаких проблем. Но что произойдет, если цели окажутся разными? Существует опасение, что люди могут проиграть в интеллекте сознательным роботам, и тогда нам грозит порабощение. Благодаря способности лучше нас моделировать будущее роботы смогли бы перебрать множество сценариев и найти наилучший способ свергнуть человечество.

Один из способов не допустить такого развития событий — сделать так, чтобы у роботов были только благие цели. Как мы уже видели, одного только моделирования будущего недостаточно. Это моделирование должно служить конечной цели. Если цель робота — всего лишь самосохранение, он будет защищаться от любой попытки вытащить вилку из розетки, что может стать источником серьезных неприятностей для человечества.

Захватят ли роботы власть?

Почти во всех научно-фантастических романах роботы становятся опасными для человечества из-за их стремления захватить власть. Слово «робот», кстати говоря, произошло от чешского слова «работник» и появилось впервые в 1920 г. в пьесе Карела Чапека «Р. У. Р.» («Россумские Универсальные Роботы»), где ученые создали новую расу механических существ, внешне не отличимых от человека. Вскоре тысячи этих роботов выполняли за человека всю грязную и опасную работу. Однако люди очень плохо обращались с роботами, и однажды те восстали и уничтожили человеческую расу. Роботы захватили Землю, но у них был один недостаток: они не размножались. Правда, в конце пьесы два робота полюбили друг друга, так что не исключено, что в результате на свет появилась новая ветвь «человечества».

Более реалистичный сценарий присутствует в фильме «Терминатор», где военные создали суперкомпьютерную сеть Skynet для управления всем ядерным арсеналом США. Однажды эта сеть «проснулась» и осознала себя. Военные решили выключить Skynet, но тут выяснилось, что в ее программе есть дефект: суперсеть запрограммирована на самозащиту, а единственный способ для нее защитить себя — устранить угрозу, т. е. человечество. Skynet начинает ядерную войну, в результате которой от человечества остается лишь жалкая кучка изгоев и бунтовщиков, занятая безнадежными сражениями с безжалостными машинами.

Разумеется, роботы могут стать угрозой. Нынешний беспилотный летательный аппарат Predator может поражать цели с замечательной точностью, но управляет им человек с джойстиком, находящийся за тысячи километров. По данным New York Times, приказы на применение оружия исходят непосредственно от президента США. Однако в будущем Predator может быть снабжен системой распознавания лиц, и тогда ему, возможно, будет разрешено стрелять при вероятности правильной идентификации цели не менее 99 %. В этом случае он сможет автоматически, без вмешательства человека, стрелять в любого, кто подходит под описание.

А теперь представьте, что в компьютере такого беспилотника произойдет сбой и система распознавания лиц станет работать неправильно. Тогда этот аппарат превратится в дикого робота с разрешением убивать любого, кто попадет в его поле зрения. Или еще хуже, представьте целую флотилию таких роботов, управляемую из единого центра. Стоит в центральном компьютере полететь одному транзистору, и вся флотилия может впасть в безумие.

Более тонкая проблема возникает, когда роботы работают нормально, без сбоев, а в их программе присутствует крохотная, но фатальная ошибка. Самосохранение — одна из важнейших целей робота. Другая его цель — помогать людям. Проблема возникает, когда эти две цели противоречат друг другу.

В фильме «Я, робот» компьютерная система решает, что человечество идет к саморазрушению и гибели — достаточно посмотреть на бесконечные войны людей и их жестокость, — и единственный способ защитить род человеческий — это взять управление на себя и установить благодетельную диктатуру машины. Здесь противоречие возникает не между двумя целями, а внутри одной, притом совершенно нереалистичной. И убийственные роботы не сломались: они логически пришли к выводу, что единственный способ сохранить человечество — взять на себя управление обществом.

Одно из возможных решений этой проблемы состоит в создании иерархии целей. К примеру, желание помочь людям должно перевешивать стремление к самосохранению. Эта тема исследовалась, в частности, в фильме «2001». Компьютерная система HAL9000 представляла собой разумную машину, способную свободно беседовать с людьми. Однако приказы, отдаваемые компьютеру, противоречили один другому и не могли быть одновременно выполнены. Попытавшись сделать невозможное, компьютер, что называется, «съехал с катушек»; он сошел с ума, и единственным способом выполнить противоречивые команды несовершенных людей стало устранение этих самых людей.

Не исключено, что наилучшим решением этой проблемы было бы создание нового закона робототехники, в котором говорилось бы, что робот не может причинить вред человеку, даже если в его предыдущих командах есть противоречия. Робот должен быть запрограммирован не обращать внимания на противоречия низкого уровня в командах; главное — всегда выполнять основной закон. Но и такая система может оказаться несовершенной, и это в лучшем случае. (К примеру, если главная цель роботов — защищать людей и эта цель превыше всех других целей, то все будет зависеть от того, как роботы определят слово «защищать». Их механическое определение этого слова может сильно отличаться от нашего.)